Procedimiento, servidor y sistema para la transcripción de lengua hablada.

Un procedimiento de transcripción para la transcripción de lengua hablada en texto continuo para un usuario (U) que comprende las etapas de:

(a) introducir una lengua hablada de al menos un usuario (U) o de un interlocutor (CP) del al menos un usuario (U) dentro de un dispositivo móvil (2) del usuario respectivo (U),

(b) transportar la lengua hablada introducida como datos de cabida útil dentro de un flujo correspondiente de paquetes de datos de voz sobre IP desde dicho dispositivo móvil (2) a través de una red (6) hasta un servidor de transcripción (7);

(c) detectar una posición actual de dicho dispositivo móvil (2) evaluando los datos de posición contenidos en un encabezamiento de dichos paquetes de datos de voz sobre IP y seleccionar un leguaje de partida automáticamente dependiendo de la posición actual detectada de dicho dispositivo móvil (2);

(d) seleccionar automáticamente una lengua de destino del usuario (U) evaluando una ID de usuario contenida en el encabezamiento de dichos paquetes de datos de voz sobre IP;

(e) conmutar los flujos de paquetes de datos de voz sobre IP que transportan la lengua hablada como datos de cabida útil recibidos por dicho servidor de transcripción (7) a través de dicha red (6) desde dicho dispositivo móvil (2) mediante una unidad de conmutación (7C) de dicho servidor de transcripción (7) a diferentes terminales (8-1, 8-2, ... 8-N) de operadores dependiendo del área de la posición actual detectada de dicho dispositivo móvil (2);

(f) producir como salida dicha lengua hablada transportada a dichos operadores que revocalizan la lengua hablada producida, en la que los operadores son operadores adecuados que hablan la lengua nativa correspondiente de la posición actual detectada de dicho dispositivo móvil (2);

(g) remitir la lengua revocalizada por dicha unidad de conmutación (7C) a una unidad de reconocimiento de habla (7A) de dicho servidor de transcripción (7) que transforma la lengua hablada revocalizada en texto continuo mediante el uso de un algoritmo de reconocimiento de habla (SRA) seleccionado de diferentes algoritmos de reconocimiento de habla (SRA) dependiendo de la posición actual detectada de dicho dispositivo móvil (2);

(h) traducir el texto continuo transformado mediante una unidad de traducción (7D) de dicho servidor de transcripción (7) por medio de un algoritmo de traducción de texto (TA) adecuado de la lengua de origen seleccionada a la lengua de destino seleccionada del usuario (U);

(i) remitir el texto traducido en la lengua de destino del usuario (U) por el servidor de transcripción (7) a dicho dispositivo móvil (2) donde el texto traducido en la lengua de destino del usuario (U) se muestra en una pantalla de dicho dispositivo móvil (2) al usuario (U).

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/EP2010/066239.

Solicitante: VerbaVoice GmbH.

Inventor/es: NACHTRAB,MICHAELA, NACHTRAB-RIBBACK,ROBIN.

Fecha de Publicación: .

Clasificación Internacional de Patentes:

- G06F17/28

- G10L15/26 FISICA. › G10 INSTRUMENTOS MUSICALES; ACUSTICA. › G10L ANALISIS O SINTESIS DE LA VOZ; RECONOCIMIENTO DE LA VOZ; PROCESAMIENTO DE LA VOZ O EL HABLA; CODIFICACIÓN O DESCODIFICACIÓN DEL AUDIO O LA VOZ. › G10L 15/00 Reconocimiento de la voz (G10L 17/00 tiene prioridad). › Sistemas de síntesis de texto a partir de la voz (G10L 15/08 tiene prioridad).

- G10L15/28 G10L 15/00 […] › Detalles estructurales de sistemas de reconocimiento de la voz.

- G10L15/30 G10L 15/00 […] › Reconocimiento distribuido, p. ej. en sistemas cliente-servidor, para teléfonos móviles o aplicaciones en red.

- G10L21/00 G10L […] › Tratamiento de la señal de la voz para producir otra señal audible o no audible, p. ej. visual o táctil, con el fin de modificar su calidad o su inteligibilidad (G10L 19/00 tiene prioridad).

- H04M3/42 ELECTRICIDAD. › H04 TECNICA DE LAS COMUNICACIONES ELECTRICAS. › H04M COMUNICACIONES TELEFONICAS (circuitos para el control de otros aparatos vía cable telefónico y que no implican aparatos de conmutación telefónica G08). › H04M 3/00 Centrales automáticas o semiautomáticas. › Sistemas que proporcionan servicios o funciones especiales a los abonados (especialmente adaptada para redes de comunicación inalámbricas H04W 4/00).

PDF original: ES-2453891_T3.pdf

Fragmento de la descripción:

Procedimiento, servidor y sistema para la transcripción de lengua hablada [0001] La invención se refiere a un procedimiento, un servidor y un sistema para la transcripción de leguaje hablado en un texto continuo para un usuario, en particular para una persona con problemas auditivos o un viajero.

El documento US2008/187108A1 describe un servicio telefónico con subtítulos de texto independiente del dispositivo. Las señales de voz recibidas por un ordenador pueden ser procesadas para codificar señales de voz

como voz sobre señales IP. El ordenador puede ser un ordenador portátil móvil inalámbrico. La señal de voz sobre IP puede ser enviada por internet a un servidor asociado con un servicio de retransmisión. Una lengua hablada transportada puede ser revocalizada por un operador formado.

El documento de Bauman, N: “Web CapTel - Using your computer and any phone to make captioned

calls”, 18 de marzo de 2008 XP002612588, recuperado de la dirección de internet: url:http://hearinglosshelp.com/weblog/web-cap-tel%E2%80%94 describe un sistema en el que un usuario puede poner un número telefónico de un teléfono que el usuario pretende usar en una primera casilla y un número al que se va a llamar en una segunda casilla. El usuario luego puede escoger una preferencia de lengua.

Un usuario tal como una persona con problemas auditivos o una persona de viaje por un país extranjero a menudo se enfrenta con el problema de que no puede entender lo que un interlocutor está diciendo. En el caso de una persona con problemas auditivos o una persona sorda el usuario simplemente no entiende lo que un interlocutor está diciendo porque no puede entender acústicamente lo que el interlocutor está respondiendo en una conversación. Una persona de viaje, tal como un hombre de negocios en un país extranjero, a menudo no entiende a su interlocutor porque no entiende la lengua hablada o el dialecto hablado en el país donde está viajando.

Para las personas con discapacidades auditivas se conocen los Servicios de Retransmisión de Telecomunicación (TRS) para hacer y recibir llamadas telefónicas. En estos Servicios de Retransmisión de Telecomunicaciones convencionales una asistencia de comunicaciones (CA) retransmite una llamada de una parte a otra entre un usuario y su interlocutor. Con tal Servicio de Retransmisión de Telecomunicaciones una persona con una discapacidad auditiva puede, por ejemplo, comunicarse mediante texto con el asistente de comunicación CA y el asistente de comunicación CA se comunica por voz con la otra parte de la llamada. En este Servicio de Retransmisión de Telecomunicaciones el asistente de comunicación CA repite mediante voz lo que el usuario con problemas auditivos ha tecleado y teclea para el usuario con problemas auditivos lo que el interlocutor ha dicho.

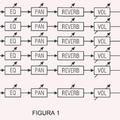

Un Servicio de Retransmisión de Telecomunicaciones TRS más reciente es el denominado Servicio Telefónico Subtitulado basado en IP. Un Servicio Telefónico Subtitulado usa un teléfono especial que tiene una pantalla de texto para mostrar subtítulos de lo que la otra parte de la conversación está diciendo a la persona con problemas auditivos. Cuando se usa un Servicio Telefónico Subtitulado basado en IP el teléfono del usuario muestra en tiempo real subtítulos de una conversación telefónica actual a la persona con problemas auditivos o sorda. Este servicio telefónico basado en IP permite que una persona con una pérdida auditiva pero que quiere usar su propia voz hable directamente a la parte a la que se llama y luego escuchar, en la medida de lo posible, a la otra parte leyendo simultáneamente subtítulos de los que la otra parte está diciendo. A diferencia de un Servicio de Retransmisión de Telecomunicaciones TRS convencional que usa texto mecanografiado, el asistente de 45 comunicaciones CA repite o revocaliza lo que se dice y, usando tecnología de reconocimiento de habla, en la que la voz del asistente de comunicación CA es transcrita automáticamente en texto y transmitida directamente al terminal del usuario con problemas auditivos quien puede leer el texto de subtítulos en su visualizador. La fig. 1 muestra un diagrama de bloques para ilustrar un Servicio Telefónico Subtitulado basado en IP. El usuario con problemas auditivos U que tiene una pérdida auditiva habla por un micrófono de su terminal y su habla es transportada a través 50 de una red al terminal de un interlocutor CP de la conversación telefónica. El habla del interlocutor CP es remitida a una Unidad de Reconocimiento de Habla SRU que transcribe el habla revocalizada del interlocutor CP proporcionada por el asistente de comunicación CA en datos de texto que son remitidos al terminal del usuario con problemas auditivos U que puede leer el texto en su visualizador.

Como puede apreciarse a partir de la fig. 1, el Servicio Telefónico Subtitulado basado en IP convencional está previsto para una conversación entre un usuario U y un interlocutor CP remoto que permite que un usuario U tal como un usuario con problemas auditivos use su propia voz para una llamada telefónica con la otra parte. Los terminales usados por el Servicio Telefónico Subtitulado basado en IP tal como se muestra en la fig. 1 son teléfonos IP especiales conectados a la red. El sistema de Servicio Telefónico Subtitulado basado en IP

convencional tal como se muestra en la fig. 1 está diseñado sobre todo para una conversación telefónica entre un usuario y un interlocutor remoto y no para una situación en la que el usuario tal como el usuario con problemas auditivos o el viajero lleva a cabo una conversación en la misma ubicación. El sistema de Servicio Telefónico Subtitulado basado en IP convencional de la fig. 1 además tiene el inconveniente de que no tiene en cuenta las 5 capacidades lingüísticas del usuario U, el interlocutor U y el asistente de comunicación CA. Por ejemplo, el usuario U

o el interlocutor CP podrían hablar otra lengua distinta del asistente de comunicación CA de manera que el asistente de comunicación CA no es capaz de revocalizar correctamente la lengua hablada del interlocutor CP. Además, podría ocurrir que aunque el interlocutor CP y el asistente de comunicación CA hablen la misma lengua, el usuario U tal como el usuario con problemas auditivos o la persona de viaje no pueda hablar esta lengua. Por otra parte, el 10 sistema convencional tal como se muestra en la fig. 1 no tiene en cuenta dónde o en qué ubicación tiene lugar la comunicación local cara a cara entre un usuario U tal como una persona de viaje y su interlocutor CP. El sistema mostrado en la fig. 1 no es adecuado, por ejemplo, para que un usuario U tal como un usuario con problemas auditivos o un hombre de negocios de viaje lleve a cabo una conversación personal cara a cara con un interlocutor CP en la calle o en una tienda. Como las capacidades lingüísticas del usuario U y la otra parte CP así como el 15 asistente de comunicación CA no se tienen en cuenta, el sistema convencional de la fig. 1 no funciona en muchas situaciones en las que las capacidades lingüísticas del asistente de comunicación CA no corresponden a las capacidades lingüísticas del usuario U y su interlocutor CP. Además, el sistema convencional de la fig. 1 no permite que el usuario tal como una persona de viaje o un usuario con problemas auditivos use su teléfono para una conversación cara a cara con otra persona, por ejemplo en una tienda o cuando consulta a un médico en un país extranjero.

Por consiguiente, un objeto de la presente invención es proporcionar un procedimiento, un servidor y un sistema para una transcripción fiable de la lengua hablada en una conversación cara a cara entre un usuario y su interlocutor.

Este objeto se consigue mediante un procedimiento de transcripción que comprende las etapas de la reivindicación 1.

Como, según el procedimiento de la presente invención, se selecciona un algoritmo de reconocimiento de 30 habla dependiendo de la posición actual detectada del dispositivo móvil respectivo para convertir las palabras habladas en texto, la exactitud y velocidad de la conversación se incrementa significativamente.

En una realización preferente del procedimiento según la presente invención, la posición actual del dispositivo móvil del usuario se determina basándose en una dirección IP asignada al dispositivo móvil respectivo.

En el procedimiento según la presente invención el texto continuo transformado es traducido por medio de un algoritmo de traducción de texto en una lengua de destino que se selecciona automáticamente evaluando una ID de usuario.

Por lo tanto, es posible que el usuario y el interlocutor puedan usar diferentes lenguas en su conversación cara a cara.

En el... [Seguir leyendo]

Reivindicaciones:

1. Un procedimiento de transcripción para la transcripción de lengua hablada en texto continuo para un usuario (U) que comprende las etapas de: 5

(a) introducir una lengua hablada de al menos un usuario (U) o de un interlocutor (CP) del al menos un usuario (U) dentro de un dispositivo móvil (2) del usuario respectivo (U) ,

(b) transportar la lengua hablada introducida como datos de cabida útil dentro de un flujo correspondiente de

paquetes de datos de voz sobre IP desde dicho dispositivo móvil (2) a través de una red (6) hasta un servidor de transcripción (7) ;

(c) detectar una posición actual de dicho dispositivo móvil (2) evaluando los datos de posición contenidos en un encabezamiento de dichos paquetes de datos de voz sobre IP y seleccionar un leguaje de partida automáticamente 15 dependiendo de la posición actual detectada de dicho dispositivo móvil (2) ;

(d) seleccionar automáticamente una lengua de destino del usuario (U) evaluando una ID de usuario contenida en el encabezamiento de dichos paquetes de datos de voz sobre IP;

(e) conmutar los flujos de paquetes de datos de voz sobre IP que transportan la lengua hablada como datos de cabida útil recibidos por dicho servidor de transcripción (7) a través de dicha red (6) desde dicho dispositivo móvil (2) mediante una unidad de conmutación (7C) de dicho servidor de transcripción (7) a diferentes terminales (8-1, 8-2, ... 8-N) de operadores dependiendo del área de la posición actual detectada de dicho dispositivo móvil (2) ;

(f) producir como salida dicha lengua hablada transportada a dichos operadores que revocalizan la lengua hablada producida, en la que los operadores son operadores adecuados que hablan la lengua nativa correspondiente de la posición actual detectada de dicho dispositivo móvil (2) ;

(g) remitir la lengua revocalizada por dicha unidad de conmutación (7C) a una unidad de reconocimiento de habla (7A) de dicho servidor de transcripción (7) que transforma la lengua hablada revocalizada en texto continuo mediante el uso de un algoritmo de reconocimiento de habla (SRA) seleccionado de diferentes algoritmos de reconocimiento de habla (SRA) dependiendo de la posición actual detectada de dicho dispositivo móvil (2) ;

(h) traducir el texto continuo transformado mediante una unidad de traducción (7D) de dicho servidor de transcripción (7) por medio de un algoritmo de traducción de texto (TA) adecuado de la lengua de origen seleccionada a la lengua de destino seleccionada del usuario (U) ;

(i) remitir el texto traducido en la lengua de destino del usuario (U) por el servidor de transcripción (7) a dicho dispositivo móvil (2) donde el texto traducido en la lengua de destino del usuario (U) se muestra en una pantalla de 40 dicho dispositivo móvil (2) al usuario (U) .

2. El procedimiento de transcripción según la reivindicación 1,

en el que los datos de posición contenidos en un encabezamiento de dichos paquetes de voz sobre IP corresponden 45 a una dirección IP asignada del dispositivo móvil (2) .

3. Un servidor de transcripción (7) para la transcripción de lengua hablada en texto continuo para un usuario (U) que comprende:

una unidad de reconocimiento de habla (7A) que está adaptada para transformar lengua hablada transportada como datos de cabida útil dentro de un flujo correspondiente de paquetes de datos de voz sobre IP desde un dispositivo móvil (2) a través de una red (6) a dicho servidor de transcripción (7) en texto continuo por medio de un algoritmo de reconocimiento de habla (SRA) ,

en el que dicho servidor de transcripción (7) está adaptado para detectar una posición actual de dicho dispositivo móvil (2) evaluando los datos de posición contenidos en un encabezamiento de paquetes de datos de voz sobre IP recibidos y para seleccionar automáticamente una lengua de origen dependiendo de la posición actual detectada del dispositivo móvil (2) y que está adaptado además para seleccionar automáticamente una lengua de destino del usuario (U) evaluando una ID de usuario contenida en el encabezamiento de los paquetes de datos de voz sobre IP recibidos,

en el que el servidor de transcripción (7) está adaptado además para seleccionar una lengua de origen de un interlocutor (CP) del usuario dependiendo de la posición actual detectada de dicho dispositivo móvil (2) ,

en el que el servidor de transcripción (7) comprende una unidad de conmutación (7C) que está adaptada para conmutar los flujos de paquetes de datos de voz sobre IP recibidos, recibidos desde el dispositivo móvil (2) del usuario (U) a través de dicha red (6) a diferentes terminales (8-1, 8-2, 8-N) de operadores dependiendo del área de la posición actual detectada de dicho dispositivo móvil (2) , en el que la lengua hablada transportada es producida como salida por dichos terminales (8-1, 8-2, 8-N) a dichos operadores que revocalizan la lengua hablada, en el que los operadores son operadores adecuados que hablan la lengua nativa correspondiente en la posición actual detectada de dicho dispositivo móvil (2) ,

en el que la unidad de conmutación (7C) está adaptada para remitir la lengua revocalizada a dicha unidad de reconocimiento de habla (7A) de dicho servidor de transcripción (7) que está adaptado para transformar la lengua hablada revocalizada del operador adecuado en texto continuo mediante el uso de un algoritmo de reconocimiento de habla (SRA) que se selecciona de diferentes algoritmos de reconocimiento de habla (SRA) proporcionados para diferentes áreas dependiendo de una lengua natural o un dialecto hablado en el área de la posición actual detectada de dicho dispositivo móvil (2) , en el que el servidor de transcripción (7) comprende además una unidad de traducción (7D) que está adaptada para traducir el texto continuo transformado por medio de un algoritmo de traducción de texto (TA) de la lengua de origen seleccionada a la lengua de destino seleccionada del usuario respectivo (U) ,

en el que dicho servidor de transcripción (7) está adaptado para remitir el texto traducido en la lengua de destino del usuario (U) a través de dicha red (6) a dicho dispositivo móvil (2) que tiene un visualizador (2B) que está adaptado para mostrar el texto traducido en la lengua de destino del usuario (U) al usuario (U) .

4. Un sistema de transcripción para la transcripción de lengua hablada en texto continuo para un usuario (U) que comprende:

un servidor de transcripción (7) según la reivindicación 3, y al menos un dispositivo móvil (2) que tiene medios de entrada (2A) para introducir una lengua hablada de al menos un usuario (U) o de un interlocutor (CP) del usuario (U) y que tiene un transceptor para establecer un enlace inalámbrico a una estación de base (3) que está conectada a una red (6) adaptada para transportar la lengua hablada introducida como datos de cabida útil dentro de un flujo correspondiente de paquetes de datos de voz sobre IP desde dicho dispositivo móvil (2) a través de dicha red (6)

hasta el servidor de transcripción (7) ,

en el que la unidad de reconocimiento de habla (7A) comprendida en dicho servidor de transcripción (7) está adaptada para cargar un algoritmo de reconocimiento de habla (SRA) desde una base de datos (7B) .

5. El sistema de transcripción según la reivindicación 4, en el que la red (6) está formada por internet.

6. El sistema de transcripción según la reivindicación 4 o 5, en el que dicho sistema de transcripción (1) está adaptado para generar subtítulos para películas, reportajes o espectáculos de TV en directo por un usuario, en particular un doblador de largometrajes o un reportero, que dicen comentarios en dicho dispositivo móvil (2) que se 45 muestran en tiempo real en una pantalla.

7. El sistema de transcripción según las reivindicaciones 4 o 5, en el que dicho sistema de transcripción (1) está adaptado para generar texto continuo en la lengua de destino para un usuario con problemas auditivos (U)

en respuesta a una lengua hablada en la lengua de origen introducida por el interlocutor (CP) de dicho usuario con 50 problemas auditivos (U) en dicho dispositivo móvil (2) de dicho usuario con problemas auditivos (U) .

8. El sistema de transcripción según una de las reivindicaciones anteriore.

4. 7, en el que dicho sistema de transcripción (1) está adaptado para generar un texto continuo traducido en la lengua de destino para una persona de viaje (U) en un país extranjero con otra lengua natural local u otro dialecto en respuesta 55 a una lengua de origen hablada introducida por un interlocutor (CP) de dicho usuario de viaje (U) en dicho dispositivo móvil (2) de dicho usuario de viaje (U) para ser mostrado en tiempo real por dicho usuario de viaje (U) en el visualizador (2B) de dicho dispositivo móvil (2) .

Patentes similares o relacionadas:

Aparato para responder a una llamada telefónica cuando un destinatario de la llamada telefónica decide que resulta inapropiado hablar y método relacionado, del 26 de Febrero de 2020, de Saronikos Trading and Services, Unipessoal Lda: Aparato (1a; 1b) para responder a una llamada telefónica cuando un destinatario de dicha llamada telefónica decide que resulta inapropiado hablar, […]

Procedimiento de asistencia en el seguimiento de una conversación para una persona con problemas de audición, del 5 de Diciembre de 2018, de Guedon, Christophe: Procedimiento de asistencia en el seguimiento de una conversación con una pluralidad de interlocutores para una persona con problemas […]

Procedimiento de sincronización entre una operación de procesamiento de reconocimiento vocal y una acción de activación de dicho procesamiento, del 4 de Abril de 2018, de Orange: Procedimiento de sincronización entre, por una parte, una operación de procesamiento por reconocimiento automático de la voz de una secuencia […]

MÉTODO DE INTERACCIÓN MEDIANTE VOZ PARA COMUNICACIÓN DURANTE CONDUCCIÓN DE VEHÍCULOS Y DISPOSITIVO QUE LO IMPLEMENTA, del 7 de Diciembre de 2017, de XESOL I MAS D MAS I, S.L: Se describe en este documento un procedimiento y un dispositivo que permiten llevar a cabo interacción mediante voz para comunicación durante […]

MÉTODO DE INTERACCIÓN MEDIANTE VOZ PARA COMUNICACIÓN DURANTE CONDUCCIÓN DE VEHÍCULOS Y DISPOSITIVO QUE LO IMPLEMENTA, del 30 de Noviembre de 2017, de XESOL I MAS D MAS I, S.L: Método de interacción mediante voz para comunicación durante conducción de vehículos y dispositivo que lo implementa. Se describe en este documento un procedimiento […]

Procedimiento y sistema para obtener información relevante de una comunicación por voz, del 6 de Abril de 2016, de TELEFONICA, S.A.: Procedimiento para obtener información relevante de una comunicación por voz proporcionada entre al menos dos usuarios, en el que la comunicación por voz comprende […]

Sistema y método para realizar consultas textuales en comunicaciones de voz, del 6 de Enero de 2016, de JaJah Ltd: Un sistema para realizar consultas textuales en comunicaciones de voz, comprendiendo el sistema:

un servicio de índices para almacenar […]

Sistema y método para realizar consultas textuales en comunicaciones de voz, del 6 de Enero de 2016, de JaJah Ltd: Un sistema para realizar consultas textuales en comunicaciones de voz, comprendiendo el sistema:

un servicio de índices para almacenar […]

Mezclador de pistas de audio semántico, del 16 de Diciembre de 2015, de FRAUNHOFER-GESELLSCHAFT ZUR FORDERUNG DER ANGEWANDTEN FORSCHUNG E.V.: Mezclador de audio para mezclar una pluralidad de pistas de audio para dar una senal de mezcla (MS), comprendiendo el mezclador de audio:

[…]

Mezclador de pistas de audio semántico, del 16 de Diciembre de 2015, de FRAUNHOFER-GESELLSCHAFT ZUR FORDERUNG DER ANGEWANDTEN FORSCHUNG E.V.: Mezclador de audio para mezclar una pluralidad de pistas de audio para dar una senal de mezcla (MS), comprendiendo el mezclador de audio:

[…]