Dispositivo para interaccionar con flujos de contenido en tiempo real.

Interfaz (30) de usuario para interaccionar con un dispositivo que recibe y transforma flujos de contenido enuna presentación para su emisión,

que comprende:

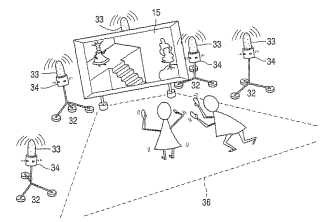

al menos un sensor (32) para detectar un movimiento realizado por un usuario situado en un área (36) deinteracción próxima a una ubicación en la que se emite la presentación, estando dicho sensor (32)dispuesto para apuntar hacia dicha área (36) de interacción,

en la que se determina un tipo de movimiento correspondiente a dicho movimiento detectado analizandouna señal de detección procedente de dicho al menos un sensor (32), y

en la que el tipo de movimiento son diferentes expresiones faciales o gestos manuales realizados por elusuario, un gesto que imita el uso de un dispositivo o una herramienta, o una cantidad de fuerza ovelocidad con la que el usuario realiza un gesto, y

en la que la presentación se controla manipulando uno o más flujos de contenido basándose en dichotipo de movimiento determinado, y se activa o desactiva un flujo de contenido recibido en la presentaciónbasándose en el tipo de movimiento determinado.

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/IB2002/001666.

Solicitante: KONINKLIJKE PHILIPS ELECTRONICS N.V..

Nacionalidad solicitante: Países Bajos.

Dirección: GROENEWOUDSEWEG 1 5621 BA EINDHOVEN PAISES BAJOS.

Inventor/es: STIENSTRA,MARCELLE A.

Fecha de Publicación: .

Clasificación Internacional de Patentes:

- G06F3/01 FISICA. › G06 CALCULO; CONTEO. › G06F PROCESAMIENTO ELECTRICO DE DATOS DIGITALES (sistemas de computadores basados en modelos de cálculo específicos G06N). › G06F 3/00 Disposiciones de entrada para la transferencia de datos destinados a ser procesados en una forma utilizable por el computador; Disposiciones de salida para la transferencia de datos desde la unidad de procesamiento a la unidad de salida, p. ej. disposiciones de interfaz. › Disposiciones de entrada o disposiciones combinadas de entrada y salida para la interacción entre el usuario y el computador (G06F 3/16 tiene prioridad).

- G10H1/00 G […] › G10 INSTRUMENTOS MUSICALES; ACUSTICA. › G10H INSTRUMENTOS DE MUSICA ELECTROFONICOS; INSTRUMENTOS EN LOS QUE LOS TONOS SON GENERADOS POR MEDIOS ELECTROMECANICOS O POR GENERADORES ELECTRONICOS, O EN LOS QUE LOS SONIDOS SON SINTETIZADOS A PARTIR DE UNA MEMORIA DE DATOS. › Elementos de instrumentos de música electrofónicos (teclados que se adaptan también a otros instrumentos de música G10B, G10C; disposiciones para producir una reverberación sonora o un eco G10K 15/08).

- H04N21/422 ELECTRICIDAD. › H04 TECNICA DE LAS COMUNICACIONES ELECTRICAS. › H04N TRANSMISION DE IMAGENES, p. ej. TELEVISION. › H04N 21/00 Distribución selectiva de contenido, p. ej. televisión interactiva, VBD [Video Bajo Demanda] (transmisión bidireccional en tiempo real de datos de vídeo en movimiento H04N 7/14). › Periféricos solo de entrada, p. ej. Sistema de Posicionamiento Global[GPS].

PDF original: ES-2403044_T3.pdf

Fragmento de la descripción:

Dispositivo para interaccionar con flujos de contenido en tiempo real

La presente invención se refiere a un sistema y a un método para recibir y presentar visualmente flujos de contenido en tiempo real. Específicamente, la presente invención permite que un usuario interaccione con y personalice los flujos de contenido en tiempo real presentados visualmente.

La narración de historias y otras formas de narración siempre han sido una forma popular de entretenimiento y educación. Entre las primeras formas de éstas están la narración oral, canciones, comunicación escrita, teatro y publicaciones impresas. Como resultado de los avances tecnológicos de los siglos XIX y XX, ahora pueden difundirse historias a grandes números de personas en ubicaciones diferentes. Medios de difusión, tales como radio y televisión, permiten que los narradores de historias expresen sus ideas a audiencias transmitiendo un flujo de contenido, o datos, simultáneamente a dispositivos de usuario final que transforman los flujos para una emisión de audio y/o visual.

Tales medios de difusión están limitados en el sentido de que transmiten un único flujo de contenido a los dispositivos de usuario final, y por tanto transmiten una historia que no puede desviarse de su secuencia predeterminada. Los usuarios de estos dispositivos son meramente espectadores y no pueden influir en el desenlace de la historia. La única interacción que un usuario puede tener con los flujos de contenido en tiempo real difundidos a través de la televisión o radio es cambiar entre flujos de contenido, es decir, cambiando el canal. Sería ventajoso proporcionar a los usuarios una mayor interacción con el proceso de narración de historias, permitiéndoles ser creativos y ayudar a determinar cómo se desarrolla la trama según sus preferencias, y por tanto hacer que disfrute más con la experiencia.

En la actualidad, los ordenadores proporcionan un medio para que los usuarios interaccionen con flujos de contenido en tiempo real. Por ejemplo, se han creado juegos de ordenador que permiten a los usuarios controlar las acciones de un personaje situado en un entorno virtual, tal como una cueva o un castillo. Un jugador debe controlar su personaje para interaccionar con otros personajes, sortear obstáculos y elegir qué trayecto tomar dentro del entorno virtual. En juegos de ordenador en línea, se difunden flujos de contenido en tiempo real desde un servidor a múltiples ordenadores personales a través de una red, de manera que múltiples jugadores pueden interaccionar con los mismos personajes, obstáculos y entorno. Aunque tales juegos de ordenador proporcionan a los usuarios una cierta libertad para determinar cómo se desarrolla la historia (es decir, lo que le sucede al personaje) , la historia tiende a ser muy repetitiva y carece de valor dramático, puesto que se requiere que el personaje repita las mismas acciones (por ejemplo disparar un arma) , dando como resultado los mismos efectos, durante la mayor parte de la duración del juego.

También se han desarrollado diversos tipos de software educativos para niños que permiten que los niños interaccionen con un entorno de narración de historias en un ordenador. Por ejemplo, LivingBooks® ha desarrollado un tipo de “libro interactivo” que divide una historia en varias escenas, y después de reproducir un breve fragmento animado para cada escena, permite que un niño manipule diversos elementos en la escena (por ejemplo, “apuntar y hacer clic” con un ratón) para reproducir breves animaciones o gags. Otros tipos de software proporcionan a los niños herramientas para expresar sus propios sentimientos y emociones creando sus propias historias. Además de tener un valor de entretenimiento, la narración de historias interactiva ha demostrado ser una herramienta potente para desarrollar las habilidades lingüísticas, sociales y cognitivas de niños pequeños.

Sin embargo, un problema asociado con software de este tipo es que los niños requieren habitualmente usar o bien un teclado o bien un ratón para interaccionar. Tales dispositivos de entrada deben sostenerse de una manera particular y requerir una determinada cantidad de coordinación mano-ojo, y por tanto pueden ser muy difíciles de usar con niños más pequeños. Además, una parte muy importante del desarrollo cognitivo temprano de niños es tratar con su entorno físico. Una interfaz que fomente que los niños interaccionen “jugando” es ventajosa frente a la interfaz de teclado y ratón convencional, porque es más beneficiosa desde una perspectiva educativa, es más intuitiva y fácil de usar, y jugar proporciona una mayor motivación para que los niños participen en el proceso de aprendizaje. Además, una interfaz que amplié el área de juego (es decir, el área en la que los niños pueden interaccionar) , y que permita igualmente que los niños interaccionen con objetos con los que juegan normalmente, puede fomentar una interacción más lúdica.

ActiMates™ Barney™ es un producto de aprendizaje interactivo creado por Microsoft Corp.®, que consiste en un ordenador pequeño integrado en un muñeco de felpa animado. Una descripción más detallada de este producto se proporciona en el artículo, E. Strommen, “When the Interface is a Talking Dinosaur: Learning Across Media with ActiMates Barney”, Proceedings of CHI ’98, páginas 288-295. Los niños interaccionan con el juguete apretando la mano del muñeco para jugar a juegos, apretando el dedo gordo del pie para escuchar canciones, y tapando los ojos del muñeco para jugar a “cucutrás”. ActiMates™ Barney™ también puede recibir señales de radio desde un ordenador personal e instruir a los niños mientras juegan a juegos educativos ofrecidos por el software ActiMates™. Aunque este producto particular fomenta la interacción entre los niños, la interacción implica sólo seguir instrucciones. El muñeco no enseña creatividad ni colaboración, que son muy importantes en el aprendizaje de desarrollo, porque no permite que el niño controle ninguna de las acciones.

CARESS (Creating Aesthetically Resonant Environments in Sound) es un proyecto para diseñar herramientas que motiven a los niños a desarrollar habilidades de creatividad y comunicación utilizando una interfaz informática que convierte los gestos físicos en sonido. La interfaz incluye sensores que pueden llevarse puestos que detectan actividad muscular y son lo suficientemente sensibles para detectar movimientos intencionados. Estos sensores son particularmente útiles para permitir que niños con discapacidades físicas se expresen y se comuniquen con los demás, motivándolos así a participar en el proceso de aprendizaje. Sin embargo, el proyecto CARESS no contempla una interfaz que permita al usuario cualquier tipo de interacción con flujos de contenido.

En el documento US4569026A, los actores y personajes de dibujos animados responden de manera receptiva con sonido sincronizado con los labios a palabras pronunciadas por los espectadores. Se generan diferentes tramas de audio y vídeo a partir de un disco de vídeo y una memoria de datos para proporcionar una de varias respuestas alternativas o acciones alternativas en cada punto de ramificación en el juego, dependiendo de lo que el espectador diga a una unidad de reconocimiento de habla. Se presenta visualmente un menú de palabras propuestas en una unidad manual para informar a los espectadores de las palabras que pueden usar en cada punto de ramificación. Sin embargo, no se detectan movimientos o tipos de movimientos para controlar el juego.

El documento US5442168 da a conocer un controlador que incluye un diodo emisor de luz para emitir radiación a un volumen de espacio discreto distribuido lateralmente por encima de una única fuente de radiación con un sensor que recibe la radiación desde la única fuente. La radiación se refleja desde un objeto que está situado dentro del volumen de espacio para proporcionar una señal de sensor a partir de la cual se determina la posición relativa del objeto y se genera una señal de control representativa de la posición del objeto. Esta construcción es, sin embargo, muy limitada a la hora de determinar diferentes tipos de movimientos. Básicamente sólo puede reconocer que hay un movimiento, y sólo si se produce dentro de dicho volumen de espacio.

El documento EP-654779 se refiere a un sistema multimedia para el control y generación de música y animación. El sistema incluye un sensor para detectar movimiento. Una unidad adquiere y procesa datos detectados por el sensor. Se operan unidades de generación de sonido, de generación de imagen, de control de imagen y de control de efectos de luz mediante la unidad de procesamiento de datos.... [Seguir leyendo]

Reivindicaciones:

1. Interfaz (30) de usuario para interaccionar con un dispositivo que recibe y transforma flujos de contenido en una presentación para su emisión, que comprende:

al menos un sensor (32) para detectar un movimiento realizado por un usuario situado en un área (36) de interacción próxima a una ubicación en la que se emite la presentación, estando dicho sensor (32) dispuesto para apuntar hacia dicha área (36) de interacción,

en la que se determina un tipo de movimiento correspondiente a dicho movimiento detectado analizando una señal de detección procedente de dicho al menos un sensor (32) , y

en la que el tipo de movimiento son diferentes expresiones faciales o gestos manuales realizados por el usuario, un gesto que imita el uso de un dispositivo o una herramienta, o una cantidad de fuerza o velocidad con la que el usuario realiza un gesto, y

en la que la presentación se controla manipulando uno o más flujos de contenido basándose en dicho tipo de movimiento determinado, y se activa o desactiva un flujo de contenido recibido en la presentación basándose en el tipo de movimiento determinado.

2. Interfaz (30) de usuario según la reivindicación 1, en la que cada flujo de contenido incluye datos de control que relacionan el flujo con un gesto particular.

3. Interfaz (30) de usuario según la reivindicación 1 ó 2, en la que dichos flujos de contenido manipulados corresponden a partes de una narración.

4. Interfaz (30) de usuario según la reivindicación 1, en la que dicho al menos un sensor (32) incluye una pluralidad de sensores, y

en la que se analizan señales de detección procedentes de dicha pluralidad de sensores para determinar una ubicación dentro de dicha área (36) de interacción en la que se produce dicho movimiento detectado.

5. Interfaz (30) de usuario según la reivindicación 4, en la que se activa o desactiva un flujo de contenido recibido en la presentación basándose en dicha ubicación determinada.

6. Interfaz (30) de usuario según la reivindicación 1, en la que dicha presentación incluye una narración.

7. Procedimiento en un sistema para transformar flujos de contenido en una presentación para su emisión, que comprende:

detectar por medio de al menos un sensor (32) un movimiento realizado por un usuario que está situado en un área (36) de interacción próxima a una ubicación en la que se emite la presentación, estando dicho sensor (32) dispuesto para apuntar hacia dicha área (36) de interacción,

en el que se determina un tipo de movimiento correspondiente a dicho movimiento detectado analizando una señal de detección; y

en el que el tipo de movimiento son diferentes expresiones faciales o gestos manuales realizados por el usuario, un gesto que imita el uso de un dispositivo o una herramienta, o una cantidad de fuerza o velocidad con la que un usuario realiza el gesto, y

en el que la presentación se controla manipulando uno o más flujos de contenido basándose en dicho movimiento determinado, y se activa o desactiva un flujo de contenido recibido en la presentación basándose en el tipo de movimiento determinado.

8. Procedimiento según la reivindicación 7, en el que cada flujo de contenido incluye datos de control que relacionan el flujo con un gesto particular.

9. Procedimiento según la reivindicación 7 u 8, en el que dichos flujos de contenido manipulados corresponden a partes de una narración.

10. Sistema que comprende:

un dispositivo (10) de usuario final para recibir y transformar flujos de contenido en una presentación; y

un dispositivo (15) de salida para emitir dicha presentación, caracterizado porque comprende además una interfaz (30) de usuario que incluye al menos un sensor (32) para detectar un movimiento realizado por un usuario que está situado en un área (36) de interacción próxima al dispositivo (15) de salida, estando dicho sensor (32) dispuesto para apuntar hacia dicha área (36) de interacción;

en el que se determina un tipo de movimiento correspondiente a dicho movimiento detectado analizando una señal de detección procedente de dicho sensor (32) ; y

en el que el tipo de movimiento son diferentes expresiones faciales o gestos manuales realizados por el 10 usuario, un gesto que imita el uso de un dispositivo o una herramienta, o una cantidad de fuerza o velocidad con la que el usuario realiza un gesto, y

en el que dicho dispositivo (10) de usuario final manipula dichos flujos de contenido transformados basándose en dicho tipo de movimiento determinado, controlando así dicha presentación, y se activa o 15 desactiva un flujo de contenido recibido en la presentación basándose en el tipo de movimiento determinado.

11. Sistema según la reivindicación 10, en el que cada flujo de contenido incluye datos de control que relacionan el flujo con un gesto particular. 20

12. Sistema según la reivindicación 10 u 11, en el que dichos flujos de contenido manipulados corresponden a partes de una narración.

Patentes similares o relacionadas:

Dispositivo de almacenamiento de sonido selectivo, del 8 de Julio de 2020, de Gibson Brands, Inc: Un medio legible por ordenador que tiene almacenadas en el mismo instrucciones legibles por ordenador que cuando las ejecuta un controlador hacen […]

Aparato y procedimiento para separación de sonido residual percusivo armónico usando un tensor de estructura sobre espectrogramas, del 25 de Marzo de 2020, de FRAUNHOFER-GESELLSCHAFT ZUR FORDERUNG DER ANGEWANDTEN FORSCHUNG E.V.: Un aparato para analizar un espectrograma de magnitud de una señal de audio, caracterizado por un determinador de cambio de frecuencia que está […]

CONTROLADOR MIDI CON SENSIBILIDAD PERSONALIZABLE, del 27 de Febrero de 2020, de PONTIFICIA UNIVERSIDAD CATÓLICA DE CHILE: Un controlador MIDI comprendiendo un cuerpo principal con un superficie de digitación curvada, en donde dicha superficie de digitación curvada está formada […]

Sincronización rítmica para atenuación cruzada de secciones de audio musical, del 12 de Febrero de 2020, de Mashtraxx Limited: Un método de atenuación cruzada o corte entre una primera sección de audio y una segunda sección de audio de destino, conteniendo cada una de la primera sección […]

Generación de una firma de una señal de audio musical, del 25 de Diciembre de 2019, de Institut Mines-Telecom: Procedimiento de generación de una firma de una señal de audio musical de una duración dada, comprendiendo el procedimiento las siguientes etapas: - modelado de dicha […]

Soporte de pastilla intercambiable para instrumento musical de cuerda, del 21 de Agosto de 2019, de LLEVINAC, S.L: Soporte de pastilla intercambiable (1, 1') para instrumento musical de cuerda, siendo dicho soporte (1, 1') del tipo que comprende al menos un cuerpo base (100, 100') […]

Procedimiento y dispositivo electrónico para reproducir un instrumento musical virtual, del 31 de Julio de 2019, de SAMSUNG ELECTRONICS CO., LTD.: Un dispositivo electrónico que comprende:

una pantalla;

al menos uno de entre un altavoz y una interfaz de sonido;

un procesador configurado para conectarse […]

Procedimiento y dispositivo electrónico para reproducir un instrumento musical virtual, del 31 de Julio de 2019, de SAMSUNG ELECTRONICS CO., LTD.: Un dispositivo electrónico que comprende:

una pantalla;

al menos uno de entre un altavoz y una interfaz de sonido;

un procesador configurado para conectarse […]

Guitarra eléctrica inalámbrica, del 2 de Julio de 2019, de Gibson Brands, Inc: Un modulo electronico para una guitarra electrica que comprende: un procesador montado dentro de una base de una guitarra electrica y configurado para recibir […]