Método, aparato y sistema de comunicación a través de vídeo.

Dispositivo (1) para el envasado de productos en un envase de papel de aluminio,

que comprende medios dealimentación para suministrar continuamente una banda de lámina (12) desde un rollo de suministro a una unidad deformación de esquinas (6), comprendiendo dicha unidad de formación de esquinas, en serie, un borde dedeformación curvado (58) para deformar la banda de lámina plana (12) en una banda de lámina curvada que tieneuna anchura reducida, por lo menos en una vista perpendicular, medios de deformación (21, 22) para formar unperfil en la banda de lámina curvada, un rodillo (59, 60) para aplanar la banda de lámina perfilada, manteniéndosepor lo menos sustancialmente la anchura reducida de la banda de lámina y formándose unas seccionessuperpuestas en la posición del perfil, y unos medios de sellado (24) para sellar dichas secciones superpuestas,comprendiendo dicho dispositivo, además, un elemento de resalte (11) al cual se le suministra la banda de lámina(12) que comprende las secciones superpuestas selladas a través de los medios de alimentación para deformar labanda de lámina en un tubo en la posición del elemento de resalte (11), a lo largo de la trayectoria de cuyo tubo sedisponen unos medios de sellado adicionales para unir entre sí bordes longitudinales de la banda de lámina yformando un lado inferior y un lado superior sellados de un envase perpendicular a la dirección longitudinal del tubo,formando las secciones selladas superpuestas las esquinas del envase, caracterizado por el hecho de que el bordede deformación (58) y los medios de deformación (21, 22) forman parte de una unidad de conmutaciónintercambiable (31) y por el hecho de que los medios de sellado (24) pueden moverse a lo largo de por lo menos unaguía (35, 49) que se extiende paralela al eje central del rodillo (59, 60), comprendiendo la unidad de formación deesquinas (6) unos elementos de alineación (45) asociados a los medios de sellado (24), cuyos elementos dealineación (45) cooperan con unos elementos de alineación adicionales (44) asociados a por lo menos algunos delos medios de deformación (21, 22) para colocar correctamente los medios de sellado (24) respecto a los medios dedeformación (21, 22).

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/CN2009/072320.

Solicitante: HUAWEI DEVICE CO., LTD.

Nacionalidad solicitante: China.

Dirección: Building B2 Huawei Industrial Base Bantian Longgang District Shenzhen Guangdong 518129 CHINA.

Inventor/es: LIU,YUAN, LIU,CHEN, FANG,Ping.

Fecha de Publicación: .

Clasificación Internacional de Patentes:

- G06T7/00 FISICA. › G06 CALCULO; CONTEO. › G06T TRATAMIENTO O GENERACIÓN DE DATOS DE IMAGEN, EN GENERAL. › Análisis de imagen.

- H04N13/00 ELECTRICIDAD. › H04 TECNICA DE LAS COMUNICACIONES ELECTRICAS. › H04N TRANSMISION DE IMAGENES, p. ej. TELEVISION. › Sistemas de video estereoscópico; Sistemas de video multivista; Sus detalles.

- H04N13/02

- H04N7/15 H04N […] › H04N 7/00 Sistemas de televisión (detalles H04N 3/00, H04N 5/00; métodos y arreglos, para la codificación, decodificación, compresión o descompresión de señales de vídeo digital H04N 19/00; distribución selectiva de contenido H04N 21/00). › Sistemas para conferencias.

PDF original: ES-2389401_T3.pdf

Fragmento de la descripción:

Método, aparato y sistema de comunicación a través de vídeo

CAMPO DE LA TECNOLOGÍA

La presente invención se refiere al campo de la comunicación a través de vídeo y más en particular, a un método, un dispositivo y un sistema de comunicación a través de vídeo que utiliza el método de comunicación a través de vídeo.

ANTECEDENTES DE LA INVENCIÓN

Con el desarrollo en curso de la tecnología de las comunicaciones, la tecnología de las comunicaciones a través de vídeo está ya ampliamente utilizada. Por ejemplo, la tecnología de comunicaciones a través de vídeo se utiliza en telefonía de vídeo, vídeoconferencia y funciones similares. Actualmente, una imagen en 2D convencional o vídeo se

utiliza principalmente en varias aplicaciones de comunicaciones a través de vídeo.

Actualmente, para la extracción de objetivo de un contenido de imagen, se adopta principalmente un método de inserción croma adoptado para extraer un objeto en primer plano en un vídeo a través de la segmentación de colores. En la comunicación a través de vídeo, el objeto del primer plano extraído se sintetiza con otros vídeos distantes para mejorar el

sentido de realidad. Por ejemplo, una persona (un objeto de primer plano) en el vídeo se sintetiza con notas de diapositivas a distancia. Sin embargo, el método de inserción croma tiene los inconvenientes siguientes.

1. El método de inserción croma requiere que un fondo del vídeo a segmentar sea de color azul, verde u otros colores simples para realizar la segmentación del objeto de primer plano desde el fondo y requiere que el color en el fondo

no aparezca en el primer plano. Los requisitos de colores para el fondo y el primer plano en el método son estrictos, lo que causa una incomodidad operativa en el uso.

2. El método de inserción croma sólo puede diferenciar el objeto del primer plano respecto al fondo y el contenido de la escena no se puede dividir en más capas, por lo que no se puede conseguir la sustitución de una parte de objetos

en el primer plano. Por ejemplo, en una escena de conferencia, podría existir un escritorio enfrente de una persona. Si un escritorio de otra parte se sustituye por un escritorio local, se puede mejorar el sentido de realidad. Sin embargo, el método de inserción croma no puede sustituir el escritorio de la otra parte con un escritorio local, por lo que no se puede mejorar todavía más el sentido de realidad.

3. La tecnología solamente realiza la sustitución de un contenido de vídeo en 2D y un usuario es incapaz de experimentar la profundidad de la escena, por lo que esta tecnología carece del sentido de realidad.

La imagen en 2D o vídeo sólo puede presentar un contenido de escenario, pero no puede reflejar la información de profundidad tal como las distancias y posiciones en el escenario.

Se utilizan seres humanos para observar el mundo exterior con dos ojos. Debido al paralaje de dos ojos, el escenario observado tiene una buena percepción de la distancia y de la posición y la sensación de estéreo del escenario se puede presentar. En la tecnología de vídeo en estéreo, el contenido de la escena que se muestra a un ojo izquierdo y a un ojo derecho de una persona son ligeramente distintas basándose en un principio de paralaje de dos ojos, con el fin de

45 permitir a la persona obtener una sensación de profundidad y capas de la escena.

Con el fin de mejorar el sentido de realidad de la comunicación a través de vídeo, en la técnica anterior, se adopta una tecnología de vídeo en estéreo y se realiza una decoración especial para escenas de ambas partes de la comunicación, de modo que los usuarios sientan que las dos partes de la comunicación están en la misma escena, con el fin de mejorar

50 el sentido de realidad. Por ejemplo, el entorno de interiores de las dos partes de la comunicación está dispuesto en la misma escena. Por lo tanto, durante la comunicación, le parece al usuario que la otra parte en el vídeo está en la misma escena. Sin embargo, un alcance de aplicación del método está limitado por la disposición del entorno de las dos partes.

En la técnica anterior, se proporciona, además, un sistema de presentación interactivo. El sistema incluye principalmente

55 una cámara de infrarrojos móvil y una unidad de reconocimiento de órdenes y una unidad de síntesis conectada a la cámara de infrarrojos. El sistema de presentación de la técnica anterior fotografía primero una imagen de un objeto de vídeo utilizando la cámara de infrarrojos móvil, con el fin de adquirir información del objeto de vídeo. Posteriormente, la unidad de reconocimiento de órdenes convierte la información en una señal de orden de salida y envía la señal de orden de salida a la unidad de síntesis. La información desde el objeto de vídeo puede incluir una imagen de infrarrojos de

60 reconocimiento de un gesto del objeto de vídeo fotografiado por la cámara de infrarrojos o voz recibida del objeto de vídeo. Por último, la unidad de síntesis sintetiza la imagen del objeto de vídeo fotografiada por la cámara de infrarrojos y una imagen de un material de presentación, controla las posiciones del objeto de vídeo y controla la visualización en pantalla del material de presentación en función de la señal de orden de salida del sistema de reconocimiento de órdenes.

Sin embargo, el sistema de presentación dado a conocer en la técnica anterior soporta solamente un modo de visualización de vídeo en 2D, pero no soporta el modo de visualización de vídeo en 3D.

El documento WO02/0269272 A2 da a conocer un sistema para insertar imágenes de vídeo de seres humanos, animales u otros seres vivos o formas de vida y cualquier ropa u objetos que lleven, en un entorno virtual. El modelo en 3D se extrae en función de las imágenes registradas por más de una cámara. Los puntos de visualización se registran por múltiples cámaras, en donde cualquier punto de visualización se registra por una cámara.

El documento IZQUIERDO E ET AL: “Presentación basada en imágenes y creación de modelos en 3D: un marco de trabajo completo”, SIGNAL PROCESSING IMAGE COMMUNICATION, ELSEVIER SCIENCE PUBLISHERS, AMSTERDAM, NODO LOCUTOR, vol. 15, nº 10, 1 agosto 2000 () , páginas 817-858, da a conocer una síntesis de múltiples puntos de visualización. Múltiples imágenes se adquieren por múltiples cámaras. El modelo en 3D se moviliza mediante análisis de múltiples puntos de visualización. De este modo, cualquier punto de visualización se adquiere de forma independiente.

El documento ZITNICK C L ET AL: “Interpolación de visualizaciones de vídeo de alta calidad utilizando una representación en capas”, ACM TRANSACTIONS ON GRAPHICS: TOG, ACM, US, vol. 23, nº 3, 8 agosto 2004 (08-082004) , páginas 600-608, se refiere a la interpolación de vistas de vídeo. Las tramas desde dos cámaras diferentes se interpolan para una sola imagen y se registran múltiples puntos de visualización.

El documento EP 1 796 047 A1 se refiere a un sistema para crear flujos de datos en 2D o en 3D desde un vídeo con objetos móviles.

El documento CN 1 275 871 A se refiere a un sistema de comunicación de imágenes-vídeo tomados con múltiples cámaras de objeto de vídeo.

SUMARIO DE LA INVENCIÓN

La presente invención se refiere a un método, aparato y sistema de comunicación a través de vídeo, que no están limitados por la disposición del entorno de dos partes de comunicación, con el fin de mejorar el sentido de realidad para las dos partes de la comunicación durante la comunicación y para visualizar un contenido de escena en un modo de vídeo en 3D.

La presente invención da a conocer un método de procesamiento de vídeo, que incluye las etapas siguientes:

Imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación se adquieren, en donde el material de presentación es un contenido a presentar que se genera por un ordenador.

Las imágenes en color/escala de grises de los al menos dos puntos de visualización... [Seguir leyendo]

Reivindicaciones:

1. Un método de procesamiento de vídeo que comprende:

la adquisición (121) de imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y de una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación, en donde el material de presentación es un contenido a presentar que se genera por un ordenador y

la sintetización (122) de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir una imagen de presentación;

caracterizado porque,

en donde la adquisición de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo a presentar, comprende:

la adquisición, utilizando una cámara que adquiere información de profundidad e imagen en color/escala de grises al mismo tiempo, de la información de profundidad en un punto de visualización y al menos una imagen en color/escala de grises del mismo punto de visualización de una escena en la que se encuentra el objeto de vídeo;

la realización de una segmentación de vídeo en la imagen en color/escala de grises del mismo punto de visualización en función de la información de profundidad del punto de visualización, de modo que se adquiera el objeto de vídeo y

la generación de una imagen en color/escala de grises del al menos otro punto de visualización del objeto de vídeo en función de la información de profundidad del punto de visualización y de la imagen en color/escala de grises del mismo punto de visualización.

2. El método de procesamiento de vídeo según la reivindicación 1 que comprende, además:

la visualización de la imagen de presentación mediante una presentación de vídeo en 3D o

la codificación de la imagen de presentación y el envío (123) de la imagen de presentación codificada.

3. El método de procesamiento de vídeo según la reivindicación 1 o 2 que comprende, además:

la codificación, por un extremo emisor, de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo a presentarse y la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación;

el envío, por el extremo emisor, de las imágenes codificadas a un extremo receptor y

en donde, el extremo receptor está configurado para: recibir las imágenes codificadas, decodificar las imágenes codificadas para obtener imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentarse y de una imagen en color/escala de grises de al menos un punto de visualización del al menos un material de presentación, para sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises de al menos un punto de visualización del al menos un material de presentación para adquirir una imagen de presentación y para visualizar la imagen de presentación mediante una presentación de vídeo en 3D.

4. El método de procesamiento de vídeo según una de las reivindicaciones 1 o 2 que comprende, además:

la adquisición, por un extremo emisor, de información de posición e información de orden de control del objeto de vídeo, en donde la información de posición se adquiere por intermedio de una imagen de profundidad, y configurada para controlar la posición del objeto de vídeo en el material de presentación, estando la información de orden de control configurada para controlar el contenido del material de presentación y la posición del objeto de vídeo en el material de presentación, en función de la imagen de profundidad, siendo reconocido el gesto desde el objeto de vídeo y la información de reconocimiento de gesto convertida en la información de orden de control, en donde

la sintetización de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización de al menos un material de presentación para adquirir la imagen de presentación comprende:

la sintetización, por el extremo emisor, de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir la imagen de presentación en función de la información de posición y de la información de orden de control.

5. El método de procesamiento de vídeo según la reivindicación 3 que comprende, además:

la adquisición, por extremo receptor, de información de posición y de información de orden de control del objeto de vídeo, en donde la información de posición se adquiere por intermedio de una imagen de profundidad y se configura para controlar la posición del objeto de vídeo en el material de presentación, estando la información de orden de control configurada para controlar el contenido del material de presentación y la posición del objeto de vídeo en el material de

presentación, en función de la imagen de profundidad, siendo reconocido el gesto del objeto de vídeo y la información de reconocimiento de gesto se convierte en la información de orden de control, en donde

la sintetización de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación 15 para adquirir la imagen de presentación comprende:

la sintetización, por el extremo receptor, de las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir la imagen de presentación en función de la información de posición y de

la información de orden de control.

6. Un dispositivo de procesamiento de vídeo que comprende:

una unidad de adquisición y de procesamiento de imágenes (191) , configurada para adquirir imágenes en color/escala

de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y de una imagen en color/escala de grises de al menos un punto de visualización del al menos un material de presentación y sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y de la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir una imagen de presentación;

caracterizado porque,

en donde la unidad de adquisición y procesamiento de imágenes comprende:

un módulo de adquisición de imágenes, configurado para adquirir, utilizando una sola cámara que puede adquirir información de profundidad e imagen en color/escala de grises al mismo tiempo, información de profundidad en un punto de visualización y al menos una imagen en color/escala de grises del mismo punto de visualización de una escena en la que se encuentra el objeto de vídeo;

un módulo de segmentación de vídeo, configurado para realizar la segmentación de vídeo en la imagen en color/escala de grises del mismo punto de visualización en función de la información de profundidad del punto de visualización para adquirir el objeto de vídeo;

un módulo de generación de imágenes con puntos de visualización múltiples, configurado para generar una imagen en 45 color/escala de grises de al menos otro punto de visualización del objeto de vídeo en función de la información de profundidad del punto de visualización y de la imagen en color/escala de grises del mismo punto de visualización y

un módulo de síntesis, configurado para sintetizar imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y la imagen en color/escala de grises del al menos un punto de visualización del al 50 menos un material de presentación con el fin de adquirir la imagen de presentación.

7. El dispositivo de procesamiento de vídeo según la reivindicación 6 que comprende, además:

una unidad de presentación visual (192) , configurada para visualizar la imagen de presentación mediante una 55 presentación de vídeo en 3D.

8. El dispositivo de procesamiento de vídeo según la reivindicación 6 que comprende, además:

una unidad de codificación configurada para codificar la imagen de presentación para obtener una imagen codificada y 60 una unidad de envío configurada para enviar la imagen codificada a un dispositivo de recepción de vídeo.

9. El dispositivo de procesamiento de vídeo según la reivindicación 7 que comprende, además:

una unidad de recepción, configurada para recibir una imagen codificada desde un dispositivo de envío de vídeo y 65 una unidad de decodificación, configurada para decodificar la imagen codificada para adquirir la imagen de presentación en donde la imagen de presentación se visualiza por una presentación de vídeo en 3D por la unidad de presentación visual.

10. Un sistema de comunicación a través de vídeo, que comprende el dispositivo de procesamiento de vídeo según una de las reivindicaciones 8 a 9 y un dispositivo de recepción de vídeo, en donde el dispositivo de recepción de vídeo comprende:

una unidad de recepción (210) , configurada para recibir la imagen codificada;

una unidad de decodificación (211) , configurada para decodificar la imagen codificada para adquirir la imagen de presentación y

una unidad de presentación visual (213) , configurada para visualizar la imagen de presentación mediante una 15 presentación de vídeo en 3D.

11. El sistema de comunicación a través de vídeo según la reivindicación 10, en donde el dispositivo de procesamiento de vídeo comprende, además:

una unidad de decodificación, configurada para decodificar la imagen codificada para obtener la imagen de presentación decodificada y

una unidad de presentación visual, configurada para realizar la visualización en 3D de la imagen de presentación.

12. El sistema de comunicación a través de vídeo según la reivindicación 10 o 11, en donde el dispositivo de recepción de vídeo comprende, además:

una unidad de adquisición y procesamiento de imágenes (221) , configurada para adquirir las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo a presentar y la imagen en color/escala de

grises del al menos un punto de visualización del al menos un material de presentación y para sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir la imagen de presentación y

una unidad de codificación (222) , configurada para codificar la imagen de presentación para obtener la imagen codificada y para enviar la imagen codificada.

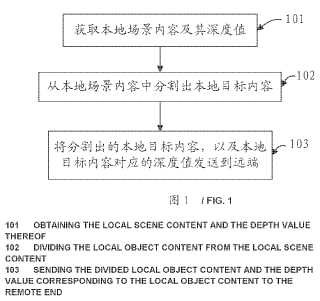

Figura 1

Figura 2 Figura 3

Figura 4

Dispositivo Dispositivo envío vídeoprocesamiento vídeo

Módulo

Módulo interfaz segmentación 22 transmisión 41

Módulo

adquisición

información 21

Módulo extracción 42

Módulo

síntesis 43

Figura 5 Módulo interfaz transmisión 64 Módulo Módulo codificación 63 decodificación 65Módulo segmentación 62

Módulo síntesis 66

Módulo extracción 69

Unidad

Unidad

escalamiento 661

segmentación 622

Unidad síntesis

Unidad búsqueda 621

Unidad reconocimiento caras 623

Módulo adquisición información 61

662

Módulo reconstrucción vistas 68

Módulo presentación visual 67

Figura 6 Figura 7

Otros primeros planos y fondos locales

Relación posiciónprofundidad después de síntesis

Persona distante

Figura 8

Un aparato de comunicación vídeo de usuario A adquiere un contenido de escena local y su valor de profundidad

El aparato de comunicación vídeo de usuario A segmenta un contenido objetivo local a partir del contenido de escena local

Memorizar un contenido residual después de que el objetivo de persona local sea segmentado desde el contenido de escena local y un valor de profundidad del contenido residual

Poner a escala un tamaño de contenido objetivo local y realizar relleno

Codificar el objetivo de persona local y su valor de profundidad

Enviar el objetivo de persona local codificado y su valor de profundidad a un aparato de comunicación vídeo de usuario B

A FIG. 9B

Figura 9A

CONT. DESDE FIG. 9A

El aparato de comunicación vídeo del usuario B recibe un objetivo de persona y su valor de profundidad enviado por el usuario A

El aparato de comunicación vídeo del usuario B decodifica los datos recibidos utilizando un módulo de decodificación

Poner a escala el objetivo de persona y su valor de profundidad enviado por el usuario A y rellenar agujeros después de la síntesis

Realizar síntesis de imagen de punto de visualización virtual sobre el contenido de escena sintetizado

Visualizar el contenido de escena sintetizado utilizando un módulo de presentación visual

Figura 9B

Módulo segmentación 1002

Red

Módulo interfaz Módulo interfaz transmisión

transmisión 1004

Módulo Módulo codificación

decodificación 1003 1006

Unidad

Unidad

Módulo síntesis1007

escalamiento

segmentación

Unidad síntesis

Unidad búsqueda Unidad

reconocimiento

caras

Módulo extracción 1010

Módulo

reconstrucción vistas 1008

Módulo adquisición información 1001

Módulo presentación visual 1009

Figura 10

Adquirir imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación

Sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir una imagen de presentación

Visualizar la imagen de presentación en un modo en 3D

Figura 11

Adquirir imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación

Sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación para adquirir una imagen de presentación

Codificar y enviar la imagen de presentación

Figura 12

Mapa profundidad

Figura 14

Figura 15

Figura 16

Adquirir imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar y una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación

Codificar y enviar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo a presentar y la imagen en color/escala de grises del al menos un punto de visualización del al menos un material de presentación

Figura 17

Decodificar una imagen codificada desde una red para obtener imágenes en color/escala de grises de al menos dos puntos de visualización de un objeto de vídeo a presentar después de la decodificación

Sintetizar las imágenes en color/escala de grises de los al menos dos puntos de visualización del objeto de vídeo y una imagen en color/escala de grises de al menos un punto de visualización de al menos un material de presentación para adquirir una imagen de presentación

Visualizar la imagen de presentación en un modo en 3D

Figura 18 Figura 19

Figura 20 Figura 21

Figura 22

Dispositivo envío vídeo Unidad adquisición y procesamiento imágenes

Unidad codificación

Unidad de envío

Unidad de recepción

Unidad decodificación

Unidad presentación visual Dispositivo recepción vídeo Figura 23

Patentes similares o relacionadas:

SISTEMA PARA ACOPLAR UN DISPOSITIVO DE DIGITALIZACIÓN DE IMÁGENES A UN INSTRUMENTO ÓPTICO, del 21 de Noviembre de 2019, de Spotlab, S.L: 1. Sistema para acoplar un dispositivo de digitalización de imágenes, que comprende al menos una lente, a un instrumento óptico que comprende […]

Seguimiento tridimensional de un dispositivo de control del usuario en un volumen, del 30 de Octubre de 2019, de zSpace, Inc: Un método que comprende: recibir múltiples imágenes capturadas de al menos un punto visualmente indicado de un dispositivo de control del usuario […]

Procedimiento de compresión de información de vídeo, del 30 de Octubre de 2019, de Broadmedia GC Corporation: Un procedimiento de compresión de información de vídeo, que comprende las etapas de:

- proyectar puntos de una imagen siguiente en puntos proyectados […]

Procedimiento de compresión de información de vídeo, del 30 de Octubre de 2019, de Broadmedia GC Corporation: Un procedimiento de compresión de información de vídeo, que comprende las etapas de:

- proyectar puntos de una imagen siguiente en puntos proyectados […]

Predicción residual avanzada simplificada para la 3d-hevc, del 14 de Junio de 2019, de QUALCOMM INCORPORATED: Un procedimiento de codificación de datos de vídeo, el procedimiento que comprende: determinar que un bloque actual (Actual) de una primera vista se codifica utilizando […]

Generación y codificación de imágenes integrales residuales, del 22 de Mayo de 2019, de Orange: Procedimiento de codificación de al menos una imagen integral actual (IIj) capturada por un dispositivo de captura de imágenes, que comprende las etapas siguientes: […]

Dispositivo de visualización auto-estereoscópico, del 27 de Marzo de 2019, de KONINKLIJKE PHILIPS N.V: Un dispositivo de visualización auto-estereoscópico que comprende: un medio de formación de la imagen que tiene una matriz bidimensional de píxeles de visualización […]

Dispositivo móvil de visualización 3D sin gafas, procedimiento de configuración del mismo, y procedimiento de uso del mismo, del 20 de Marzo de 2019, de SAMSUNG ELECTRONICS CO., LTD.: Un dispositivo de visualización tridimensional (3D) sin gafas que comprende: un dispositivo de visualización que comprende un monitor […]

Síntesis de visualización en vídeo 3D, del 6 de Marzo de 2019, de QUALCOMM INCORPORATED: Un procedimiento de descodificación de datos de vídeo de múltiples visualizaciones, el procedimiento que comprende: determinar si un índice […]