Método de codificación de vídeo y método de descodificación, dispositivo para los mismos, programas para los mismos y medios de almacenamiento para almacenar los programas.

Un método de codificación de vídeo, para codificar imágenes de vídeo como una imagen de vídeo de puntos devista múltiples,

utilizando la compensación del paralaje que efectúa la predicción utilizando el paralaje espacial entrelas imágenes de video, comprendiendo el método:

un paso (S103) de ajuste del paralaje de referencia, para ajustar el paralaje de referencia para cada pixel de unaimagen objetivo a codificar, donde se estima el paralaje de referencia utilizando imágenes de referencia sin usar laimagen objetivo;

un paso (S1067) de ajuste de la división del área, para ajustar la división del área en un fotograma de una imagen;un paso (S1062) de ajuste del desplazamiento del paralaje, para ajustar el desplazamiento del paralaje para cadaárea dividida fijada en el paso de ajuste de la división del área, donde se define el desplazamiento del paralaje comola diferencia entre el paralaje de referencia y el paralaje real utilizado para generar una imagen de predicción para lacompensación del paralaje, y tiene un valor común dentro de cada área dividida;

un paso de generación de la imagen de predicción, para generar una imagen de predicción para la compensacióndel paralaje, para cada pixel de la imagen objetivo, utilizando el paralaje real obtenido para el pixel como una unidadañadiendo el paralaje de referencia ajustado al desplazamiento del paralaje común fijado para el área a la cualpertenece el pixel;

un paso (S109) de codificación de los datos de la división del área, para codificar los datos de la división del áreapara indicar la división del área que ha sido ajustada en el paso de ajuste de la división del área; y

un paso (S109) de codificación de los datos de desplazamiento del paralaje, para codificar los datos dedesplazamiento del paralaje para indicar el desplazamiento del paralaje que ha sido fijado en el paso de ajuste deldesplazamiento del paralaje.

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/JP2007/050005.

Solicitante: NIPPON TELEGRAPH AND TELEPHONE CORPORATION.

Nacionalidad solicitante: Japón.

Dirección: 3-1, OTEMACHI 2-CHOME, CHIYODA-KU TOKYO 100-8116 JAPON.

Inventor/es: YAMAMOTO, KENJI, TANIMOTO,Masayuki, FUJII,Toshiaki, KITAHARA,Masaki, KIMATA,Hideaki, SHIMIZU,Shinya, KAMIKURA,Kazuto, YASHIMA,Yoshiyuki.

Fecha de Publicación: .

Clasificación Internacional de Patentes:

- H04N7/32

PDF original: ES-2388080_T3.pdf

Fragmento de la descripción:

Método de codificación de vídeo y método de descodificación, dispositivo para los mismos, programas para los mismos y medios de almacenamiento para almacenar los programas 5

Campo técnico

La presente invención está relacionada con técnicas de codificación y descodificación de imágenes de vídeo de puntos de vista múltiples.

Técnica anterior

Las imágenes de vídeo de puntos de vista múltiples son imágenes de vídeo obtenidas fotografiando el mismo objeto y fondo del mismo, utilizando una pluralidad de cámaras en posiciones diferentes. En lo que sigue, una imagen de

vídeo obtenida por una sola cámara es denominada “imagen de vídeo bidimensional”, y un conjunto de imágenes de vídeo bidimensionales, obtenidas fotografiando el mismo objeto y fondo del mismo, es denominada “imagen de vídeo de puntos de vista múltiples”. Hay una fuerte correlación entre las imágenes de vídeo bidimensionales (de diferentes cámaras) incluidas en la imagen de vídeo de puntos de vista múltiples. Si las cámaras están sincronizadas entre sí, los fotogramas (de las cámaras) correspondientes al mismo momento han capturado el objeto y el fondo del mismo enteramente en el mismo estado, de manera que hay una fuerte correlación entre las cámaras.

En primer lugar, se ilustrarán las técnicas convencionales relativas a la codificación de imágenes de vídeo bidimensionales. En muchos métodos conocidos de codificación de imágenes de vídeo bidimensionales, tal como el

H.264, MPEG-4, MPEG-2 (que son estándares internacionales de codificación) , y similares, se efectúa una codificación altamente eficiente por medio de la compensación del movimiento, la transformación ortogonal, la cuantificación, la codificación de longitud variable o similares.

Por ejemplo, en el H.264, cada fotograma I puede ser codificado por medio de una correlación dentro de los fotogramas (intrafotograma) ; cada fotograma P puede ser codificado por medio de una correlación entre fotogramas (interfotograma) , junto con una pluralidad de fotogramas transcurridos; y cada fotograma B puede ser codificado por medio de una correlación interfotograma junto con una pluralidad de fotogramas transcurridos o futuros.

Aunque el documento no-patente 1 divulga las técnicas H.264 en detalle, a continuación se describirá el perfil de las

mismas. En cada fotograma I, el fotograma se divide en bloques (denominados “macrobloques”, el tamaño de cada bloque es 16 x 16 (pixeles) ) , y la predicción intrafotograma (intra-predicción) se efectúa en cada macrobloque. En la intra-predicción, cada macrobloque se divide además en bloques más pequeños (denominados a continuación “subbloques”) , y se puede aplicar un método individual de intra-codificación a cada sub-bloque.

En cada fotograma P, la intra-predicción o la inter-predicción (predicción interfotograma) puede ser realizada en cada macrobloque. La intra-predicción aplicada a un fotograma P es similar a la aplicada a un fotograma I. En la inter-predicción, se realiza la compensación del movimiento. También en la compensación del movimiento, cada macrobloque se divide en bloques más pequeños, y cada sub-bloque puede tener un vector de movimiento individual y una imagen de referencia individual.

45 También en cada fotograma B se puede efectuar la intra-predicción o la inter-predicción. En la inter-predicción de un fotograma B, además de un fotograma transcurrido, se puede hacer referencia a un fotograma futuro como imagen de referencia en la compensación del movimiento. Por ejemplo, cuando se codifica una secuencia de fotogramas de “I→B→B→P”, los fotogramas pueden ser codificados en el orden de “I→P→B→B”. Además, en cada fotograma B, se puede realizar la compensación del movimiento haciendo referencia a un fotograma I o P. Adicionalmente, de forma similar al fotograma P, cada sub-bloque (obtenido dividiendo un macrobloque) puede tener un vector de movimiento individual.

Cuando se realiza una intra o inter-predicción, se obtiene una predicción residual. En cada macrobloque, un bloque

55 de predicción residual está sometido a una DCT (transformada discreta del coseno) , para realizar la cuantificación. Los valores cuantificados obtenidos de los coeficientes DCT son sometidos después a una codificación de longitud variable.

En un método de codificación conocido para imágenes de vídeo de puntos de vista múltiples, las imágenes de vídeo de puntos de vista múltiples son codificadas con una alta eficiencia por medio de la “compensación del paralaje” en la cual se aplica la compensación del movimiento a imágenes obtenidas por cámaras diferentes al mismo tiempo. En este caso, el “paralaje” es la diferencia entre posiciones, a las cuales se proyecta el mismo punto en un objeto, sobre un plano de imágenes de cámaras que están dispuestas en posiciones diferentes.

65 La figura 9 es una vista esquemática que muestra el concepto del paralaje generado entre tales cámaras. En la vista esquemática, un plano de imágenes de cámaras, cuyos ejes ópticos son paralelos entre sí, está visto hacia abajo verticalmente. Generalmente, tales puntos, a los cuales se proyecta el mismo punto en un objeto, en un plano de imágenes de cámaras diferentes, son denominados “puntos correspondientes”. Como el paralaje puede ser representado como una diferencia posicional en el plano de imagen relevante, puede ser representado como datos de un vector bidimensional.

En la compensación del paralaje, el punto correspondiente de la imagen de una cámara de referencia, que se corresponde con un pixel objetivo en una imagen de cámara objetivo para la codificación relevante, se estima utilizando una imagen de referencia, y el valor del pixel de referencia se predice utilizando un valor de pixel asignado al punto correspondiente. A continuación, tal “paralaje estimado” es denominado también “paralaje” por conveniencia de la explicación.

El documento no-patente 2 divulga un método de codificación utilizando una compensación del paralaje y, en tal método, los datos de paralaje y cada predicción residual son codificados con respecto a los pixeles de una imagen objetivo a codificar. Más específicamente, en el método relevante, la compensación del paralaje se efectúa para

cada bloque como una unidad, donde tal paralaje para cada bloque unitario se representa utilizando un vector bidimensional. La figura 10 es una vista esquemática que ilustra un vector de paralaje. Esto es, en este método, se codifican los datos de paralaje como vector bidimensional y la predicción residual relevante. Como este método no utiliza parámetros de la cámara en la codificación, es eficaz cuando los parámetros de la cámara son desconocidos.

Además, cuando hay una pluralidad de imágenes de referencia obtenidas por cámaras diferentes, la compensación del paralaje puede efectuarse utilizando una técnica de imágenes de puntos de vista arbitrarios. El documento nopatente 3 divulga la compensación del paralaje utilizando una técnica de imágenes de puntos de vista arbitrarios. Más específicamente, cada valor de pixel de una imagen obtenida por una cámara objetivo para la codificación relevante, se predice por medio de la interpolación utilizando los valores de pixel de los puntos correspondientes

(pertenecientes a cámaras diferentes) que se corresponden con el pixel relevante. La figura 11 es una vista esquemática que muestra tal interpolación. En la interpolación, el valor del pixel m en una imagen objetivo a codificar se predice efectuando la interpolación entre los pixeles m’ y m’’ de las imágenes de referencia 1 y 2, donde los pixeles m’ y m’’ se corresponden con el pixel m.

Cuando hay dos o más imágenes de referencia obtenidas por cámaras diferentes (como se divulga en el documento de patente 3) , el paralaje de cada pixel de una imagen objetivo (a codificar) para cada imagen de referencia, puede ser estimado sin utilizar la imagen objetivo. La figura 12 es una vista esquemática para ilustrar el concepto de tal estimación del paralaje.

Como se ilustra en la figura 12, en el verdadero paralaje, los valores de pixel de los puntos correspondientes entre las imágenes de referencia relevantes deben... [Seguir leyendo]

Reivindicaciones:

1. Un método de codificación de vídeo, para codificar imágenes de vídeo como una imagen de vídeo de puntos de

vista múltiples, utilizando la compensación del paralaje que efectúa la predicción utilizando el paralaje espacial entre 5 las imágenes de video, comprendiendo el método:

un paso (S103) de ajuste del paralaje de referencia, para ajustar el paralaje de referencia para cada pixel de una imagen objetivo a codificar, donde se estima el paralaje de referencia utilizando imágenes de referencia sin usar la imagen objetivo;

un paso (S1067) de ajuste de la división del área, para ajustar la división del área en un fotograma de una imagen;

un paso (S1062) de ajuste del desplazamiento del paralaje, para ajustar el desplazamiento del paralaje para cada área dividida fijada en el paso de ajuste de la división del área, donde se define el desplazamiento del paralaje como

la diferencia entre el paralaje de referencia y el paralaje real utilizado para generar una imagen de predicción para la compensación del paralaje, y tiene un valor común dentro de cada área dividida;

un paso de generación de la imagen de predicción, para generar una imagen de predicción para la compensación del paralaje, para cada pixel de la imagen objetivo, utilizando el paralaje real obtenido para el pixel como una unidad añadiendo el paralaje de referencia ajustado al desplazamiento del paralaje común fijado para el área a la cual pertenece el pixel;

un paso (S109) de codificación de los datos de la división del área, para codificar los datos de la división del área para indicar la división del área que ha sido ajustada en el paso de ajuste de la división del área; y

un paso (S109) de codificación de los datos de desplazamiento del paralaje, para codificar los datos de desplazamiento del paralaje para indicar el desplazamiento del paralaje que ha sido fijado en el paso de ajuste del desplazamiento del paralaje.

2. El método de codificación de vídeo, de acuerdo con la reivindicación 1, en el que:

el ajuste de la división del área en el paso de ajuste de la división del área, se efectúa por medio de un método seleccionado entre una pluralidad de métodos de división del área para realizar la división del área en bloques rectangulares.

3. Un método de descodificación de vídeo, para descodificar imágenes de vídeo como una imagen de vídeo de puntos de vista múltiples, utilizando la compensación del paralaje que realiza la predicción, utilizando el paralaje espacial entre las imágenes de vídeo, comprendiendo el método:

un paso (S202) de ajuste del paralaje de referencia, para fijar el paralaje de referencia para cada pixel en una imagen objetivo a descodificar, donde el paralaje de referencia se estima utilizando imágenes de referencia sin utilizar la imagen objetivo;

un paso (S204) de descodificación de datos de la división de área, para descodificar los datos de división del área 45 para indicar la división del área, donde los datos de división de área están incluidos en los datos codificados;

un paso (S206) de descodificación de los datos de desplazamiento del paralaje, para descodificar los datos del desplazamiento del paralaje para cada área indicada por los datos de división del área, que son descodificados en el paso de descodificación de datos de la división del área, donde los datos del desplazamiento del paralaje están incluidos en los datos codificados, y el desplazamiento del paralaje se define como la diferencia entre el paralaje de referencia y el paralaje real utilizado para generar una imagen de predicción para la compensación del paralaje y tiene un valor común dentro de cada área indicada por los datos de división del área; y

un paso (S207) de generación de la imagen de predicción, para generar la imagen de predicción para la

55 compensación del paralaje para cada pixel de la imagen objetivo, utilizando el paralaje real obtenido para el pixel como una unidad, añadiendo el paralaje de referencia ajustado al desplazamiento del paralaje común que se ha fijado para el área a la cual pertenece el pixel.

4. El método de descodificación de vídeo, de acuerdo con la reivindicación 3, en el que:

los datos de división del área descodificados en el paso de descodificación de los datos de la división del área indican un método seleccionado entre una pluralidad de métodos de división de área para efectuar la división del área en bloques rectangulares.

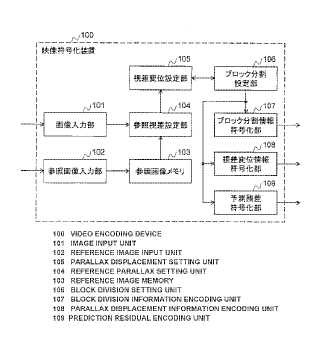

65 5. Un dispositivo de codificación de vídeo para codificar imágenes de vídeo como una imagen de vídeo de puntos de vista múltiples, utilizando la compensación del paralaje que realiza la predicción utilizando el paralaje espacial entre

imágenes de vídeo, comprendiendo el dispositivo:

un dispositivo (104) de ajuste del paralaje de referencia, para fijar el paralaje de referencia para cada pixel de una imagen objetivo a codificar, donde el paralaje de referencia se estima utilizando imágenes de referencia sin utilizar la 5 imagen de referencia;

un dispositivo (106) de ajuste de la división del área, para fijar la división del área en un fotograma de una imagen;

un dispositivo (105) de ajuste del desplazamiento del paralaje, para fijar el desplazamiento del paralaje para cada área dividida fijada por el dispositivo de ajuste de división del área, donde el desplazamiento del paralaje está definido como la diferencia entre el paralaje de referencia y el paralaje real utilizado para generar una imagen de predicción para la compensación del paralaje, y tiene un valor común dentro de cada área dividida;

un dispositivo (109) de generación de imágenes de predicción, para generar la imagen de predicción para la

compensación del paralaje, para cada pixel de la imagen objetivo, utilizando el paralaje real que es obtenido para el pixel como unidad, añadiendo el paralaje de referencia fijado al desplazamiento del paralaje común que es fijado por el área a la cual pertenece el pixel;

un dispositivo (107) de codificación de datos de división del área, para codificar los datos de división del área para indicar la división de área que ha sido fijada por el dispositivo de ajuste de división del área; y

un dispositivo (108) de codificación de los datos del desplazamiento del paralaje, para codificar los datos de desplazamiento del paralaje para indicar el desplazamiento del paralaje que se ha fijado por el dispositivo de ajuste de desplazamiento del paralaje.

6. Un dispositivo de descodificación de vídeo, para descodificar imágenes de vídeo como una imagen de vídeo de puntos de vista múltiples, utilizando la compensación del paralaje que efectúa la predicción utilizando el paralaje espacial entre las imágenes de vídeo, comprendiendo el dispositivo:

un dispositivo (204) de ajuste del paralaje de referencia, para ajustar el paralaje de referencia para cada pixel en una imagen objetivo a descodificar, donde el paralaje de referencia se estima utilizando imágenes de referencia sin utilizar la imagen objetivo;

un dispositivo (201) de descodificación de los datos de división del área, para descodificar los datos de división del 35 área para indicar la división del área, donde los datos de división del área están incluidos en los datos codificados;

un dispositivo (202) de descodificación de los datos de desplazamiento del paralaje, para descodificar datos del desplazamiento del paralaje para cada área indicada por los datos de división del área, que son descodificados por el dispositivo de descodificación de datos de división del área, donde los datos del desplazamiento del paralaje están incluidos en los datos codificados, y el desplazamiento del paralaje se define como la diferencia entre el paralaje de referencia y el paralaje real utilizado para generar una imagen de predicción para la compensación del paralaje, y tiene un valor común dentro de cada área indicada por los datos de división del área; y

un dispositivo (204) de generación de imágenes de predicción, para generar la imagen de predicción para la

45 compensación del paralaje, para cada pixel de la imagen objetivo, utilizando el paralaje real que se obtiene para el pixel como una unidad, añadiendo el paralaje de referencia fijado al desplazamiento del paralaje común, que está fijado para el área a la cual pertenece el pixel.

7. Un programa de codificación de vídeo, para hacer que un ordenador ejecute el método de codificación de vídeo de acuerdo con la reivindicación 1.

8. Un programa de descodificación de vídeo, para hacer que un ordenador ejecute el método de codificación de vídeo de acuerdo con la reivindicación 3.

55 9. Un medio de almacenamiento legible por ordenador, que almacena un programa de descodificación de vídeo para hacer que un ordenador ejecute el método de codificación de vídeo de acuerdo con la reivindicación 1.

10. Un medio de almacenamiento legible por ordenador, que almacena un programa de descodificación de vídeo para hacer que un ordenador ejecute el método de descodificación de vídeo de acuerdo con la reivindicación 3.

11. El método de codificación de vídeo, de acuerdo con la reivindicación 1, en el que:

en el paso de generación de imágenes de predicción, la imagen de predicción se genera basándose en los valores de los pixeles de las imágenes de referencia.

12. El método de codificación de vídeo, de acuerdo con la reivindicación 11, en el que: en el paso de generación de imágenes de predicción, la imagen de predicción se genera calculando un promedio entre los valores de los pixeles de las imágenes de referencia.

13. El método de descodificación de vídeo, de acuerdo con la reivindicación 3, en el que: en el paso de generación de imágenes de predicción, la imagen de predicción se genera basándose en los valores de los pixeles de las imágenes de referencia. 10 14. El método de descodificación de vídeo, de acuerdo con la reivindicación 13, en el que: en el paso de generación de imágenes de predicción, la imagen de predicción se genera calculando un promedio entre los valores de los pixeles de las imágenes de referencia. 15 15. El dispositivo de codificación de vídeo, de acuerdo con la reivindicación 6, en el que: el dispositivo de generación de imágenes de predicción genera la imagen de predicción basándose en los valores de los pixeles de las imágenes de referencia. 20 16. El dispositivo de codificación de vídeo, de acuerdo con la reivindicación 15, en el que: el dispositivo de generación de imágenes de predicción genera la imagen de predicción calculando el promedio entre los valores de los pixeles de las imágenes de referencia. 25 17. El dispositivo de descodificación de vídeo, de acuerdo con la reivindicación 7, en el que: el dispositivo de generación de imágenes de predicción genera la imagen de predicción basándose en los valores de los pixeles de las imágenes de referencia. 30 18. El dispositivo de descodificación de vídeo, de acuerdo con la reivindicación 17, en el que:

el dispositivo de generación de imágenes de predicción genera la imagen de predicción calculando el promedio entre los valores de los pixeles de las imágenes de referencia.

Patentes similares o relacionadas:

Interpolación mejorada de cuadros de compresión de vídeo, del 4 de Diciembre de 2019, de DOLBY LABORATORIES LICENSING CORPORATION: Un método para compresión de imágenes de video usando predicción en modo directo, que incluye: proporcionar una secuencia de cuadros predichos […]

Interpolación mejorada de cuadros de compresión de vídeo, del 4 de Diciembre de 2019, de DOLBY LABORATORIES LICENSING CORPORATION: Un método de compresión de imágenes de video que comprende: proporcionar una secuencia de cuadros referenciables (I, P) y predichos bidireccionales […]

Ponderación adaptativa de imágenes de referencia en codificación de vídeo, del 27 de Marzo de 2019, de InterDigital VC Holdings, Inc: Un aparato de codificación para producir datos de vídeo para una imagen que tiene una pluralidad de bloques de imagen, incluyendo los datos de […]

Un método y un aparato para descodificar/codificar una señal de video, del 17 de Mayo de 2017, de LG ELECTRONICS INC.: Un método para descodificar datos de video multi-visualización en una corriente de video multi-visualización, que comprende: recibir la corriente […]

Procedimiento y dispositivo de decodificación que utiliza codificación subbanda de una unidad de conversión de frecuencia, del 26 de Abril de 2017, de SK TELECOM CO., LTD.: Aparato de decodificación de video que comprende un decodificador para recibir datos codificados para reconstruir un bloque de conversión de frecuencia transformado […]

Método de codificación escalable de vídeo y métodos de decodificación que utilizan predicción ponderada, dispositivos para ello, programas para ello, y medio de grabación donde se graba el programa, del 19 de Abril de 2017, de NIPPON TELEGRAPH AND TELEPHONE CORPORATION: Un método de codificación escalable de video, que comprende: - para cada una de las regiones de imagen de referencia: calcular un coeficiente de […]

Método y dispositivo de control de codificación de predicción intra, su programa, y medio de almacenamiento que contiene programa, del 29 de Marzo de 2017, de NIPPON TELEGRAPH AND TELEPHONE CORPORATION: Un método de control de codificación de predicción intra usado en codificación de predicción intra que tiene una pluralidad de modos de la predicción […]

Método de codificación de imágenes y aparato de codificación de imágenes, del 15 de Febrero de 2017, de Sun Patent Trust: Un método de codificación de imágenes para generar una corriente de bits codificada mediante la codificación de una imagen utilizando una descripción de memoria […]