DISPOSICION Y PROCEDIMIENTO PARA GENERAR IMAGENES DE PRESENCIA CONTINUA.

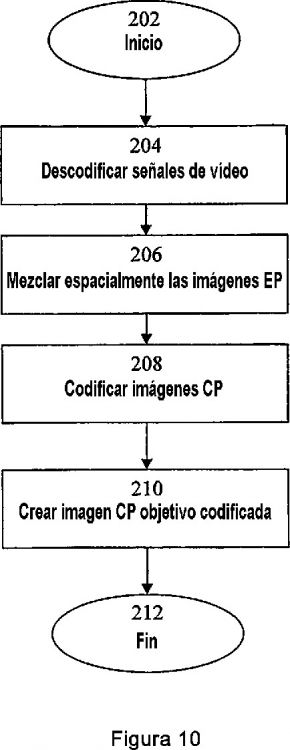

Procedimiento para crear una imagen de presencia continua (CP) objetivo codificada según una norma de codificación de vídeo a partir de una pluralidad de señales de vídeo codificadas incluyendo órdenes definidos de macrobloques,

comprendiendo cada uno señales de vídeo codificadas correspondientes a una imagen de vídeo respectiva de terminal final recibida desde terminales finales que participan en una conferencia de vídeo multipunto, caracterizado por el hecho de que el procedimiento comprende las siguientes etapas:

- descodificar dichas señales de vídeo codificadas, dando como resultado imágenes de vídeo de terminal final,

- mezclar espacialmente dichas imágenes de vídeo de terminal final, dando como resultado una pluralidad de imágenes CP compuestas por regiones asociadas respectivamente con cada una de dichas imágenes de vídeo de terminal final,

- codificar dichas imágenes CP,

- reorganizar los macrobloques de las imágenes CP codificadas, creando de ese modo dicha imagen CP codificada objetivo

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/NO2005/000050.

Solicitante: TANDBERG TELECOM AS.

Nacionalidad solicitante: Noruega.

Dirección: PHILIP PEDERSENS VEI 22,1366 LYSAKER.

Inventor/es: JOHANSEN,TOM-IVAR, LIA,TOM,ERIK.

Fecha de Publicación: .

Fecha Concesión Europea: 16 de Junio de 2010.

Clasificación Internacional de Patentes:

- H04N7/15M

Clasificación PCT:

- H04N7/15 ELECTRICIDAD. › H04 TECNICA DE LAS COMUNICACIONES ELECTRICAS. › H04N TRANSMISION DE IMAGENES, p. ej. TELEVISION. › H04N 7/00 Sistemas de televisión (detalles H04N 3/00, H04N 5/00; métodos y arreglos, para la codificación, decodificación, compresión o descompresión de señales de vídeo digital H04N 19/00; distribución selectiva de contenido H04N 21/00). › Sistemas para conferencias.

Clasificación antigua:

- H04N7/15 H04N 7/00 […] › Sistemas para conferencias.

Fragmento de la descripción:

Disposición y procedimiento para generar imágenes de presencia continua.

Campo de la invención

La presente invención se refiere a la videoconferencia y, en particular, a la generación de imágenes de presencia continua (CP, Continuous Presence) en una unidad de control multipunto (MCU, Multipoint Control Unit).

Antecedentes de la invención

La transmisión de imágenes en movimiento en tiempo real se utiliza en varias aplicaciones tales como, por ejemplo, videoconferencias, reuniones a través de la red, difusión de TV y videotelefonía.

Sin embargo, la representación de imágenes en movimiento requiere una gran cantidad de información ya que el vídeo digital se describe normalmente representando cada píxel de una imagen con 8 bits (1 octeto). Tales datos de vídeo no comprimidos dan como resultado grandes volúmenes de bits y no pueden transferirse a través de redes de comunicación y líneas de transmisión convencionales en tiempo real debido a un ancho de banda limitado.

Por lo tanto, permitir la transmisión de vídeo en tiempo real requiere un alto grado de compresión de datos. Sin embargo, la compresión de datos puede comprometer la calidad de las imágenes. Por lo tanto, se han llevado a cabo grandes esfuerzos para desarrollar técnicas de compresión que permitan la transmisión en tiempo real de vídeo de alta calidad a través de conexiones de datos limitadas por el ancho de banda.

En los sistemas de compresión de vídeo, el objetivo principal es representar la información de vídeo con la menor capacidad posible. La capacidad se define con bits, ya sea como un valor constante o como una unidad de bits/tiempo. En ambos casos, el objetivo principal es reducir el número de bits.

El procedimiento de codificación de vídeo más común se describe en las normas MPEG* y H.26*. Los datos de vídeo pasan por cuatro procesos principales antes de su transmisión, concretamente predicción, transformación, cuantificación y codificación de entropía.

El proceso de predicción reduce significativamente la cantidad de bits requerida para cada imagen de una secuencia de vídeo que va a transferirse. Aprovecha la similitud de partes de la secuencia con otras partes de la secuencia. Puesto que la parte de predicción es conocida tanto para el codificador como para el descodificador, solo tiene que transferirse la diferencia. Esta diferencia requiere normalmente mucha menos capacidad para su representación. La predicción se basa principalmente en el contenido de la imagen a partir de imágenes reconstruidas anteriormente en las que la ubicación del contenido se define mediante vectores de movimiento. El proceso de predicción se realiza normalmente en tamaños de bloques cuadrados (por ejemplo, 16x16 píxeles).

Los sistemas de videoconferencia permiten el intercambio simultáneo de información de audio, de vídeo y de datos entre múltiples emplazamientos de la conferencia. Los sistemas conocidos como unidades de control multipunto (MCU) llevan a cabo funciones de conmutación para permitir que múltiples emplazamientos se intercomuniquen en una conferencia. La MCU conecta los emplazamientos entre sí recibiendo tramas de señales de conferencia desde los emplazamientos, procesando las señales recibidas y retransmitiendo las señales procesadas a los emplazamientos apropiados. Las señales de conferencia incluyen información de audio, de vídeo, de datos y de control. En una conferencia conmutada, la señal de vídeo de uno de los emplazamientos de la conferencia, normalmente el del interlocutor que hable más alto, se difunde a cada uno de los participantes. En una conferencia de presencia continua, las señales de vídeo de dos o más emplazamientos se mezclan espacialmente para formar una señal de vídeo compuesta para su visualización por parte de los participantes de la conferencia. La imagen compuesta o de presencia continua es una imagen combinada que puede incluir flujos de vídeo en directo, imágenes estáticas, menús u otras imágenes visuales de los participantes de la conferencia.

En una conferencia de presencia continua típica, la visualización de vídeo se divide en una distribución compuesta que presenta áreas o regiones (por ejemplo, cuadrantes). Los emplazamientos se seleccionan en la configuración de la conferencia a partir de los emplazamientos conectados en la conferencia para su visualización en las regiones. Las distribuciones compuestas comunes incluyen cuatro, nueve o dieciséis regiones. La distribución se selecciona y después se fija durante la duración de la conferencia.

Algunas disposiciones de conferencia proporcionan diferentes señales compuestas o una mezcla de vídeo de manera que cada emplazamiento puede ver una mezcla diferente de emplazamientos. Otra disposición utiliza una selección de cuadrantes activados por voz para asociar emplazamientos con cuadrantes particulares. Esa disposición permite a los participantes de la conferencia ver no solamente emplazamientos fijos de mezcla de vídeo, sino también un emplazamiento seleccionado en función de la actividad de voz. Sin embargo, la distribución, en lo que respecta al número de regiones o cuadrantes, es fija para la conferencia.

Haciendo referencia ahora a la Fig. 1, se muestra un diagrama esquemático de una realización de una MCU 10 del tipo desvelado en la patente estadounidense 5.600.646, cuya descripción se incorpora expresamente en este documento como referencia. La MCU 10 incluye además funcionalidad H.323 tal y como se desvela en la patente estadounidense 6.404.745, cuya descripción también se incorpora expresamente en este documento como referencia. Además, el procesamiento de vídeo en la MCU se ha mejorado, tal y como se describirá en detalle en este documento. Las características descritas en este documento para la MCU 10 pueden representarse en una MCU Tandberg.

La MCU 10 incluye al menos una unidad de interfaz de red (NIU, Network Interface Unit) 120, al menos una unidad de procesamiento de puente (BPU, Bridge Processing Unit) 122, una unidad de procesamiento de vídeo (VPU, Video Processing Unit) 124, una unidad de procesamiento de datos (DPU, Data Processing Unit) 126 y una unidad de procesamiento principal (HPU, Host Processing Unit) 130. Además de un bus de control principal 132 de la Arquitectura Estándar Industrial (ISA, Industry Standard Architecture), la MCU 10 incluye un bus de red 134, un bus BPU 136 y un bus X 138. El bus de red 134 cumple con el protocolo de integración de múltiples fabricantes (MVIP, Multi-Vendor Integration Protocol), mientras que el bus BPU 136 y el bus X son derivados de la especificación MVIP. La HPU 130 proporciona una interfaz de gestión para operaciones MCU. Cada uno de los elementos MCU anteriores se describe en detalle en las patentes estadounidenses 5.600.646 y 6.404.745 mencionadas anteriormente.

La funcionalidad H.323 se proporciona mediante la adición de una unidad de procesamiento de pasarela (GPU, Gateway Processing Unit) 128 y de una BPU modificada denominada como una BPU-G 122A. La GPU 128 utiliza protocolos H.323 para la señalización de llamadas y la creación y control de flujos de audio, de vídeo y de datos a través de una Ethernet u otra interfaz LAN 140 para terminales finales. La BPU-G 122A es una BPU 122 que está programada para procesar paquetes de audio, de vídeo y de datos recibidos desde la GPU 128.

A continuación se describe el funcionamiento de una MCU a un alto nivel, inicialmente para conferencias por conmutación de circuitos y después para conferencias H.323 por conmutación de paquetes. En conferencias por conmutación de circuitos, las tramas de datos digitales de terminales finales H.320 de conmutación de circuitos se vuelven disponibles en el bus de red 134 a través de una interfaz de red 142 para una NIU 120. Las BPU 122 procesan las tramas de datos a partir del bus de red 134 para generar tramas de datos que se vuelven disponibles para otras BPU 122 en el bus BPU 136. Las BPU 122 también extraen información de audio de las tramas de datos.

Las BPU 122 combinan información de vídeo comprimida e información de audio codificada mezclada en tramas que se colocan en el bus de red 134 para su transmisión a terminales H.320 respectivos.

En casos en los que los terminales audiovisuales funcionan a diferentes velocidades de transmisión o con diferentes algoritmos de compresión o van a mezclarse en una imagen compuesta, múltiples entradas de vídeo se envían a la VPU 124, en donde las entradas de vídeo se descomprimen, se mezclan y...

Reivindicaciones:

1. Procedimiento para crear una imagen de presencia continua (CP) objetivo codificada según una norma de codificación de vídeo a partir de una pluralidad de señales de vídeo codificadas incluyendo órdenes definidos de macrobloques, comprendiendo cada uno señales de vídeo codificadas correspondientes a una imagen de vídeo respectiva de terminal final recibida desde terminales finales que participan en una conferencia de vídeo multipunto, caracterizado por el hecho de que el procedimiento comprende las siguientes etapas:

2. Procedimiento según la reivindicación 1, que comprende además la siguiente etapa adicional, antes de la etapa de crear la imagen CP objetivo codificada:

3. Procedimiento según la reivindicación 1, en el que dicha etapa de codificar dichas imágenes CP comprende establecer órdenes definidos de macrobloques correspondientes a la norma de codificación de vídeo y una fusión de los límites de región y los límites de macrobloque.

4. Procedimiento según la reivindicación 3, en el que las imágenes CP codificadas y la imagen CP objetivo codificada están cada una en un formato CIF con 18 grupos de bloques (GOB), incluyendo cada uno 22 macrobloques, dispuestos en una formación apilada de manera que los 9 primeros GOB representan regiones superiores y los últimos 9 GOB representan regiones inferiores.

5. Procedimiento según la reivindicación 4, en el que la etapa de crear la imagen CP objetivo codificada incluye:

6. Procedimiento según la reivindicación 5, en el que m=11, n=9 y dichas regiones representan cada una un cuadrante de una imagen CP.

7. Procedimiento según la reivindicación 5, en el que m=7 o m=8, n=6 y dichas regiones representan cada una un octavo de una imagen CP.

8. Disposición en una unidad de control multipunto (MCU) para crear una imagen CP objetivo codificada según una norma de codificación de vídeo a partir de una pluralidad de señales de entrada de vídeo codificadas, correspondiéndose cada una con una imagen de vídeo respectiva de terminal final recibida desde terminales finales que participan en una conferencia de vídeo multipunto,

caracterizada por

9. Disposición según la reivindicación 8, en la que las imágenes CP codificadas y la imagen CP objetivo codificada están cada una en un formato CIF con 18 grupos de bloques (GOB), incluyendo cada uno 22 macrobloques, dispuestos en una formación apilada de manera que los 9 primeros GOB representan regiones superiores y los últimos 9 GOB representan regiones inferiores.

10. Disposición según la reivindicación 9, en la que dicho dispositivo de reorganización está configurado además para sustituir m números de macrobloques que representan un ancho de región en n números de GOB subsiguientes que representan una altura de región en una primera imagen de la pluralidad de imágenes CP codificadas por m números de macrobloques en n números de GOB subsiguientes de una segunda imagen de la pluralidad de imágenes CP codificadas.

11. Disposición según la reivindicación 10, en la que m=11, n=9 y dichas regiones representan cada una un cuadrante de una imagen CP.

12. Disposición según la reivindicación 10, en la que m=7 o m=8, n=6 y dichas regiones representan cada una un octavo de una imagen CP.

Patentes similares o relacionadas:

Sistema y método para la asignación inteligente de ancho de banda en sistemas de comunicación multimedia de pista múltiple, del 20 de Abril de 2020, de LÓPEZ FERNÁNDEZ, Luis: Sistema y método para la asignación inteligente de ancho de banda en sistemas de comunicación multimedia de pista múltiple. Un sistema y […]

Método y sistema para mejorar y ampliar la funcionalidad de una videollamada, del 12 de Febrero de 2020, de DEUTSCHE TELEKOM AG: Método para mejorar la funcionalidad de una videollamada utilizando una red de telecomunicaciones, en donde la videollamada representa un […]

Sistema de conferencias para la formación de intérpretes, del 29 de Enero de 2020, de Televic Education NV: Un sistema de conferencias adecuado para la formación de intérpretes, comprendiendo el sistema de conferencias:

- una unidad central ,

- una unidad de […]

Sistema de conferencias para la formación de intérpretes, del 29 de Enero de 2020, de Televic Education NV: Un sistema de conferencias adecuado para la formación de intérpretes, comprendiendo el sistema de conferencias:

- una unidad central ,

- una unidad de […]

Sistema de conferencia, método para operar la unidad de delegado y programa informático, del 14 de Noviembre de 2019, de ROBERT BOSCH GMBH: Sistema de conferencia que comprende al menos una unidad de delegado , comprendiendo la unidad de delegado un micrófono , un medio de señalización (6, […]

INTERFAZ DE SERVICIO DEL USUARIO Y PLATAFORMA DE GESTIÓN PARA VIDEOCONFERENCIA Y ACTIVIDADES DE COLABORACIÓN, del 23 de Mayo de 2019, de LATIN TELECOMUNICACIONES S.A: Un método, sistema y plataforma son presentados para permitir una interacción más completa y profunda entre usuarios en una sala de reunión y multiples fuente […]

Cámara para comunicar una transmisión continua multimedia a un Cliente Remoto, del 8 de Mayo de 2019, de Librestream Technologies Inc: Una Cámara Móvil de Transmisión Continua , operable por un operador para comunicarse con al menos un Cliente Remoto que comprende: una carcasa […]

Procedimiento, dispositivo y sistema para establecer concatenación entre controladores multipunto, del 25 de Abril de 2019, de HUAWEI TECHNOLOGIES CO., LTD.: Un procedimiento para establecer una cascada de servidores de control multipunto , que comprende: predefinir y almacenar información de conferencia en una […]

COMUNICADOR PARA ENFERMERIA, del 25 de Abril de 2017, de BUSCATEL COMUNICACIONES S.L: 1. Comunicador para enfermería, actividades hospitalarias o residenciales similares que, comprendiendo una pluralidad de terminales de habitación y […]