Codificación y decodificación de imágenes multivista usando corrección de iluminación y de color localizada.

Un método de codificación de imágenes multivista en el que una imagen de entrada de un objeto que es fotografiado por una primera cámara se divide en una pluralidad de zonas objeto de codificación y,

usando una imagen de síntesis de vistas que se sintetiza a partir de la información de profundidad para la imagen de entrada y a partir de una imagen ya codificada del mismo objeto fotografiado por una segunda cámara que está situada en una posición diferente a la de la primera cámara, se realiza codificación predictiva para cada una de las zonas objeto de codificación, que comprende una etapa de codificación de imagen (A12) durante la cual, usando la imagen de síntesis de vistas, se codifica una señal de imagen de la imagen objeto de codificación de manera que se crean datos codificados, siendo los datos codificados decodificados de manera que se crea una imagen decodificada para la zona objeto de codificación en una etapa de decodificación de imagen (A13); estando el método de codificación de imágenes multivista caracterizado porque comprende:

- una etapa de determinación de profundidad representativa (A6) durante la cual se establece la información de profundidad representativa para un objeto fotografiado en la zona objeto de codificación,

- una etapa de determinación de grupo de píxeles de muestra (A6) durante la cual en la imagen de entrada se determina un grupo de píxeles en el que se ha fotografiado el mismo objeto que en la zona objeto de codificación seleccionando píxeles de una zona ya codificada que es adyacente a la zona objeto de codificación, en la que la diferencia absoluta entre un valor de profundidad de la misma y el valor de profundidad representativo es menor que un umbral predefinido y el grupo de píxeles se establece como un grupo de píxeles de muestra,

- una etapa de estimación de parámetros de corrección (A8) durante la cual, basándose en la imagen de síntesis de vistas para el grupo de píxeles de muestra y en una imagen decodificada que ha sido decodificada para el grupo de píxeles de muestra, se estiman los parámetros de corrección para corregir al menos una de las ausencias de correspondencia de iluminación o de color de manera que se reduzca al mínimo la suma de valores que representan un error entre los valores de píxel de la imagen decodificada para el grupo de píxeles de muestra y los valores de píxel de la imagen de síntesis de vistas para el grupo de píxeles de muestra que son corregidos usando un modelo de corrección para el grupo de píxeles de muestra, y

- una etapa de corrección de imágenes de síntesis de vistas (A9) durante la cual la imagen de síntesis de vistas para el objeto es corregida de manera que se crea una imagen de síntesis de vistas corregida aplicando una función de corrección definida por los parámetros de corrección para la imagen de síntesis de vistas;

en el que la señal de imagen de la imagen objeto de codificación se codifica usando la imagen de síntesis de vistas corregida en la etapa de codificación de imagen (A12).

Tipo: Patente Internacional (Tratado de Cooperación de Patentes). Resumen de patente/invención. Número de Solicitud: PCT/JP2010/001213.

Solicitante: NIPPON TELEGRAPH AND TELEPHONE CORPORATION.

Nacionalidad solicitante: Japón.

Dirección: 3-1 Otemachi 2-chome Chiyoda-ku, Tokyo 100-8116 JAPON.

Inventor/es: TANIMOTO,Masayuki, KIMATA,Hideaki, SHIMIZU,Shinya.

Fecha de Publicación: .

Clasificación Internacional de Patentes:

- H04N7/32

PDF original: ES-2524973_T3.pdf

Fragmento de la descripción:

Codificación y decodificación de imágenes multivista usando corrección de iluminación y de color localizada

Campo técnico La presente invención se refiere a un método de codificación de imágenes multivista y un dispositivo para codificar imágenes fotografiadas por una pluralidad de cámaras que están fotografiando un objeto en particular, y también a un método de decodificación de imágenes multivista y un dispositivo para decodificación de datos codificados que han sido codificados usando este método de codificación de imágenes multivista, y también a un programa de codificación de imágenes multivista que se usa para implementar este método de codificación de imágenes multivista, y a un programa de decodificación de imágenes multivista que se usa para implementar este método de decodificación de imágenes multivista.

Técnica anterior

El término ’imágenes multivista’ se refiere a una pluralidad de imágenes obtenidas fotografiando el mismo objeto y el fondo usando una pluralidad de cámaras, mientras que el término imágenes en movimiento multivista (es decir, ’vídeo multivista’) ’ se refiere a imágenes en movimiento obtenidas de esta manera.

La predicción con compensación de movimiento y la predicción con compensación de disparidad se han propuesto como tecnologías para su uso en la codificación de imágenes en movimiento general y la codificación de imágenes en movimiento multivista.

La predicción con compensación de movimiento es un método que se emplea también en las normas internacionales para los formatos de codificación de imágenes en movimiento de los últimos años tipificados por H.264. En este método, el movimiento de un objeto se compensa entre una trama destinada a codificación y una trama de referencia que ya ha sido codificada de manera que se obtiene una diferencia inter-trama para la señal de imagen, y sólo se codifica esta señal de diferencia (véase el documento no patente 1) .

En cambio, en la predicción con compensación de disparidad, al compensar las disparidades en un objeto usando una trama fotografiada por una cámara diferente a la de la trama de referencia, la codificación puede realizarse como las diferencias inter-trama entre las señales de imagen que se están obteniendo (véase el documento no patente 2) .

El término ’disparidad’ que se usa en el presente documento se refiere a diferencias en las posiciones en los planos de imagen de cámaras colocadas en diferentes posiciones en las que se proyecta la misma posición en un objeto. En la predicción con compensación de disparidad, esto se representa mediante vectores bidimensionales y después se codifica. Tal como se muestra en la figura 9, dado que las disparidades son información cuya creación depende de la posición de la cámara y de la distancia desde la cámara (es decir, la profundidad) , existe un método conocido como predicción de síntesis de vistas (predicción de interpolación de vistas) que usa este principio.

En la predicción de síntesis de vistas (predicción de interpolación de vistas) , existe un método en el que la profundidad de un objeto se estima usando la información de la posición de la cámara y la teoría de la triangulación 45 para los vídeos multivista obtenidos en el lado de codificación o el lado de decodificación, y las tramas destinadas a su codificación se sintetizan (es decir, se interpolan) usando esta información de profundidad estimada de manera que se crea una imagen de predicción (véanse el documento no patente 1 y el documento no patente 3) . Debe observarse que si la profundidad se estima en el lado de codificación, es necesario codificar la profundidad que se usa.

En la predicción que usa imágenes fotografiadas usando estas cámaras separadas, si existen diferencias individuales entre las respuestas de los elementos de obtención de imágenes de las cámaras, o si se aplica control de ganancia o corrección gamma en cada cámara, o si los ajustes de la profundidad de campo o la apertura o similares son diferentes en cada cámara, o si existe un efecto de iluminación dependiente de la dirección en la 55 escena, o similares, entonces la eficacia de codificación se deteriora. Esto se debe a que la predicción se realiza con la suposición de que la iluminación y el color del objeto son los mismos tanto en la trama destinada a codificación como en la trama de referencia.

Se están investigando métodos tales como compensación de iluminación y corrección de color como formas de abordar los cambios en la iluminación y el color de un objeto. En estos métodos, usando una trama de referencia cuya iluminación y cuyo color hayan sido corregidos como trama que se usa para realizar una predicción, es posible limitar a un mínimo la magnitud de la predicción residual que se codifica.

En H.264, se adopta la predicción ponderada en la que se usa una función lineal como modelo de corrección (véase 65 el documento no patente 1) , mientras que en el documento no patente 3 se propone un método en el que las correcciones se realizan usando una tabla de colores.

[DOCUMENTOS DE LA TÉCNICA ANTERIOR]

[Documento de patente 1] Solicitud de patente japonesa abierta a consulta por el público (JP-A) nº 2007-036.800 5 "Método de codificación de vídeo, método de decodificación de vídeo, programa de codificación de vídeo, programa de decodificación de vídeo y medio de grabación legible por ordenador en el que se graban estos programas"

[Documento no patente 1]

ITU-T Rec. H.264/ISO/IEC 11496-10, "Codificación de vídeo avanzada para los servicios audiovisuales genéricos", Borrador de Comité Final, Documento JVT-E022d7, septiembre de 2002. (pág. 10-13, pág. 62-73)

[Documento no patente 2]

Hideaki Kimata y Masaki Kitahara, "Preliminar y results on multiple view video coding (3DAV) ", documento M10976 MPEG Redmond Meeting, julio de 2004.

[Documento no patente 3]

K. Yamamoto, M. Kitahara, H. Kimata, T. Yendo, T. Fujii, M. Tanimoto, S. Shimizu, K. Kamikura y Y. Yashima, "Multiview Video Coding Using View Interpolation and Color Correction”, IEEE Transactions on Circuits and System for Video Technology, Vol. 17, nº 11, pág. 1436-1449, noviembre de 2007.

Descripción de la invención Problema que debe ser resuelto por la invención Cuando se realiza una codificación usando la compensación de iluminación y corrección de color mencionada anteriormente se producen los dos problemas siguientes.

El primer problema es el aumento en la cantidad de código que procede de la adición de parámetros para compensación de iluminación y corrección de color y similares. En predicción con compensación de disparidad normal y predicción de síntesis (interpolación) de vistas, dado que se hace necesario codificar parámetros para compensación de iluminación y corrección de color y similares que anteriormente no habían necesitado codificación,

existe un deterioro en la eficacia de codificación.

El segundo problema es la exactitud de la corrección. En caso de fundido y parpadeo en la codificación normal de imágenes en movimiento, dado que toda la pantalla cambia de la misma forma, es posible realizar una compensación de iluminación y una corrección de color y similares satisfactorias usando un único parámetro de corrección. Sin embargo, las ausencias de correspondencia (es decir, las discrepancias en iluminación y color) que son causadas porque el objeto no es un reflector difuso completo, o porque la profundidad de campo y el enfoque no guardan una total correspondencia en cada cámara no dependen de la escena, sino del objeto. En consecuencia, en la corrección que se basa en un único parámetro de corrección, se producen casos en los que, dependiendo del objeto, se incrementa la ausencia de correspondencia.

Para contrarrestar este problema, puede considerarse un método en el que se usa una pluralidad de parámetros de corrección con el fin de abordar la ausencia de correspondencia en cada objeto individual. Sin embargo, si se usa este método, entonces además de la cantidad de código requerida para codificar una pluralidad de parámetros de corrección, es necesario también codificar información que muestre el parámetro de corrección que deberá usarse en cada zona de imagen. En consecuencia, la cantidad de código aumenta todavía más, y no es posible resolver el primer problema.

La presente invención se concibió a la luz de las circunstancias descritas anteriormente, y un objeto de la misma es proporcionar una nueva tecnología de codificación y decodificación de imágenes multivista que consiga una 55 codificación altamente... [Seguir leyendo]

Reivindicaciones:

1. Un método de codificación de imágenes multivista en el que una imagen de entrada de un objeto que es fotografiado por una primera cámara se divide en una pluralidad de zonas objeto de codificación y, usando una imagen de síntesis de vistas que se sintetiza a partir de la información de profundidad para la imagen de entrada y a partir de una imagen ya codificada del mismo objeto fotografiado por una segunda cámara que está situada en una posición diferente a la de la primera cámara, se realiza codificación predictiva para cada una de las zonas objeto de codificación, que comprende una etapa de codificación de imagen (A12) durante la cual, usando la imagen de síntesis de vistas, se codifica una señal de imagen de la imagen objeto de codificación de manera que se crean datos codificados, siendo los datos codificados decodificados de manera que se crea una imagen decodificada para la zona objeto de codificación en una etapa de decodificación de imagen (A13) ; estando el método de codificación de imágenes multivista caracterizado porque comprende:

-una etapa de determinación de profundidad representativa (A6) durante la cual se establece la información de 15 profundidad representativa para un objeto fotografiado en la zona objeto de codificación,

-una etapa de determinación de grupo de píxeles de muestra (A6) durante la cual en la imagen de entrada se determina un grupo de píxeles en el que se ha fotografiado el mismo objeto que en la zona objeto de codificación seleccionando píxeles de una zona ya codificada que es adyacente a la zona objeto de codificación, en la que la diferencia absoluta entre un valor de profundidad de la misma y el valor de profundidad representativo es menor que un umbral predefinido y el grupo de píxeles se establece como un grupo de píxeles de muestra,

-una etapa de estimación de parámetros de corrección (A8) durante la cual, basándose en la imagen de síntesis de vistas para el grupo de píxeles de muestra y en una imagen decodificada que ha sido decodificada para el grupo de

píxeles de muestra, se estiman los parámetros de corrección para corregir al menos una de las ausencias de correspondencia de iluminación o de color de manera que se reduzca al mínimo la suma de valores que representan un error entre los valores de píxel de la imagen decodificada para el grupo de píxeles de muestra y los valores de píxel de la imagen de síntesis de vistas para el grupo de píxeles de muestra que son corregidos usando un modelo de corrección para el grupo de píxeles de muestra, y

-una etapa de corrección de imágenes de síntesis de vistas (A9) durante la cual la imagen de síntesis de vistas para el objeto es corregida de manera que se crea una imagen de síntesis de vistas corregida aplicando una función de corrección definida por los parámetros de corrección para la imagen de síntesis de vistas;

en el que la señal de imagen de la imagen objeto de codificación se codifica usando la imagen de síntesis de vistas corregida en la etapa de codificación de imagen (A12) .

2. El método de codificación de imágenes multivista según la reivindicación 1, en el que:

-se proporciona una etapa de determinación de objeto (A4) durante la cual los píxeles en la zona objeto de codificación se dividen en uno o varios grupos usando la información de profundidad para los píxeles pertinentes como referencia, y

-en la etapa de determinación de profundidad representativa, se establece la información de profundidad 45 representativa para cada grupo determinado en la etapa de determinación de objeto,

-en la etapa de determinación de grupo de píxeles de muestra, se establece un grupo de píxeles de muestra para cada grupo determinado en la etapa de determinación de objeto,

-en la etapa de estimación de parámetros de corrección, se estiman los parámetros de corrección para cada grupo determinado en la etapa de determinación de objeto, y

-en la etapa de corrección de imágenes de síntesis de vistas, se corrige una imagen de síntesis de vistas para cada grupo determinado en la etapa de determinación de objeto.

3. El método de codificación de imágenes multivista según la reivindicación 1 ó 2, en el que:

-se proporciona una etapa de selección de modelo de corrección (A7) durante la cual se selecciona un modelo de corrección para corregir la imagen de síntesis de vistas para la zona objeto de codificación de acuerdo con el número de píxeles en el grupo de píxeles de muestra, y

-en la etapa de estimación de parámetros de corrección, se estiman los parámetros de corrección para el modelo de corrección seleccionado en la etapa de selección de modelo de corrección, y

-en la etapa de corrección de imágenes de síntesis de vistas, se corrige la imagen de síntesis de vistas usando el modelo de corrección seleccionado en la etapa de selección de modelo de corrección.

4. Un método de decodificación de imágenes multivista en el que una imagen objeto de decodificación de un objeto que es fotografiado por una primera cámara se divide en una pluralidad de zonas objeto de decodificación, y usando una imagen de síntesis de vistas que se sintetiza a partir de la información de profundidad para la imagen objeto de decodificación y a partir de una imagen decodificada del mismo objeto fotografiado por una segunda cámara que está situada en una posición diferente a la de la primera cámara, se realiza decodificación predictiva para cada una de las zonas objeto de decodificación, que comprende una etapa de decodificación de imagen (B12) en la que, usando la imagen de síntesis de vistas, se decodifica una señal de imagen de la imagen objeto de decodificación; estando el método de decodificación de imágenes multivista caracterizado porque comprende:

-una etapa de determinación de profundidad representativa (B6) durante la cual se establece la información de profundidad representativa para un objeto fotografiado en la zona objeto de decodificación,

-una etapa de determinación de grupo de píxeles de muestra (B6) durante la cual se determina un grupo de píxeles

en el que el mismo objeto que en la zona objeto de decodificación ha sido fotografiado en la imagen objeto de decodificación seleccionando píxeles de una zona ya codificada que es adyacente a la zona objeto de codificación, en la que la diferencia absoluta entre un valor de profundidad de la misma y el valor de profundidad representativo es menor que un umbral predefinido y el grupo de píxeles se establece como un grupo de píxeles de muestra,

-una etapa de estimación de parámetros de corrección (B8) durante la cual, basándose en la imagen de síntesis de vistas para el grupo de píxeles de muestra y en una imagen decodificada que ha sido decodificada para el grupo de píxeles de muestra, se estiman los parámetros de corrección para corregir al menos una de las ausencias de correspondencia de iluminación o de color de manera que se reduzca al mínimo la suma de valores que representan un error entre los valores de píxel de la imagen decodificada para el grupo de píxeles de muestra y los valores de

píxel de la imagen de síntesis de vistas para el grupo de píxeles de muestra que son corregidos usando un modelo de corrección para el grupo de píxeles de muestra, y

-una etapa de corrección de imágenes de síntesis de vistas (B9) durante la cual se corrige la imagen de síntesis de vistas para el objeto de manera que se crea una imagen de síntesis de vistas corregida aplicando una función de corrección definida por los parámetros de corrección para la imagen de síntesis de vistas;

en el que la señal de imagen de la imagen objeto de decodificación se decodifica usando la imagen de síntesis de vistas corregida en la etapa de decodificación de imagen (B12) .

5. El método de decodificación de imágenes multivista según la reivindicación 4, en el que:

-se proporciona una etapa de determinación de objeto (B4) durante la cual los píxeles en la zona objeto de decodificación se dividen en uno o varios grupos usando la información de profundidad para los píxeles pertinentes como referencia, y

-en la etapa de determinación de profundidad representativa, se establece la información de profundidad representativa para cada grupo determinado en la etapa de determinación de objeto,

-en la etapa de determinación de grupo de píxeles de muestra, se establece un grupo de píxeles de muestra para 45 cada grupo determinado en la etapa de determinación de objeto,

-en la etapa de estimación de parámetros de corrección, se estiman los parámetros de corrección para cada grupo determinado en la etapa de determinación de objeto, y

-en la etapa de corrección de imágenes de síntesis de vistas, se corrige una imagen de síntesis de vistas para cada grupo determinado en la etapa de determinación de objeto.

6. El método de decodificación de imágenes multivista según la reivindicación 4 ó 5, en el que:

-se proporciona una etapa de selección de modelo de corrección (B7) durante la cual se selecciona un modelo de corrección para corregir la imagen de síntesis de vistas para la zona objeto de decodificación de acuerdo con el número de píxeles en el grupo de píxeles de muestra, y

-en la etapa de estimación de parámetros de corrección, se estiman los parámetros de corrección para el modelo de corrección seleccionado en la etapa de selección de modelo de corrección, y

-en la etapa de corrección de imágenes de síntesis de vistas, se corrige la imagen de síntesis de vistas usando el modelo de corrección seleccionado en la etapa de selección de modelo de corrección.

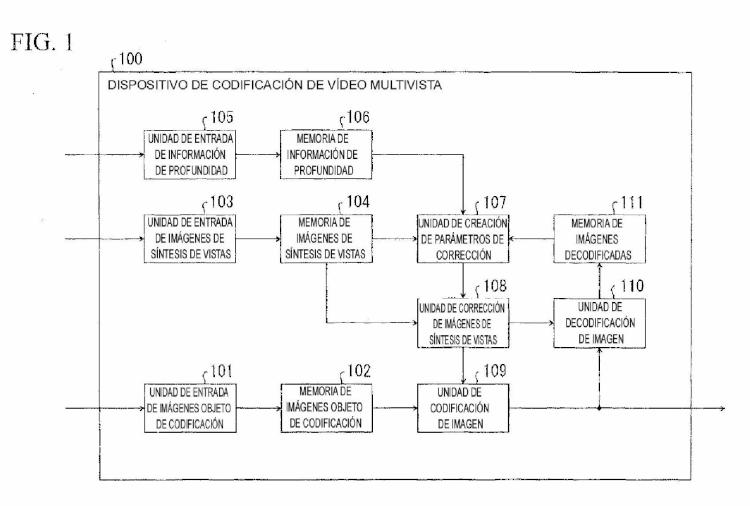

7. Un dispositivo de codificación de imágenes multivista que codifica imágenes multivista dividiendo una imagen de entrada de un objeto que es fotografiado por una primera cámara en una pluralidad de zonas objeto de codificación

y, usando una imagen de síntesis de vistas que se sintetiza a partir de la información de profundidad para la imagen de entrada y a partir de una imagen ya codificada del mismo objeto fotografiado por una segunda cámara que está situada en una posición diferente a la de la primera cámara, realizando codificación predictiva para cada una de las zonas objeto de codificación, que comprende una unidad de codificación de imagen (109) que, usando la imagen de síntesis de vistas, codifica una señal de imagen de la imagen objeto de codificación de manera que se crean datos codificados, siendo los datos codificados decodificados de manera que se crea una imagen decodificada para la zona objeto de codificación mediante una unidad de decodificación de imagen (110) , estando el dispositivo de codificación de imágenes multivista caracterizado porque comprende:

-una unidad de determinación de profundidad representativa (107b) que establece la información de profundidad representativa para un objeto fotografiado en la zona objeto de codificación,

-una unidad de determinación de grupo de píxeles de muestra (107c) que determina un grupo de píxeles en el que el mismo objeto que en la zona objeto de codificación ha sido fotografiado en la imagen de entrada seleccionando

píxeles de una zona ya codificada que es adyacente a la zona objeto de codificación, en la que la diferencia absoluta entre un valor de profundidad de la misma y el valor de profundidad representativo es menor que un umbral predefinido y el grupo de píxeles se establece como un grupo de píxeles de muestra,

-una unidad de estimación de parámetros de corrección (107e) que, basándose en la imagen de síntesis de vistas para el grupo de píxeles de muestra y en una imagen decodificada que ya ha sido decodificada para el grupo de píxeles de muestra, estima los parámetros de corrección para corregir al menos una de las ausencias de correspondencia de iluminación o de color de manera que se reduzca al mínimo la suma de valores que representan un error entre los valores de píxel de la imagen decodificada para el grupo de píxeles de muestra y los valores de píxel de la imagen de síntesis de vistas para el grupo de píxeles de muestra que son corregidos usando un modelo

de corrección para el grupo de píxeles de muestra, y

-una unidad de corrección de imágenes de síntesis de vistas (108) que corrige la imagen de síntesis de vistas para el objeto de manera que se crea una imagen de síntesis de vistas corregida aplicando una función de corrección definida por los parámetros de corrección para la imagen de síntesis de vistas;

en el que la unidad de codificación de imagen (109) codifica la señal de imagen de la imagen objeto de codificación usando la imagen de síntesis de vistas corregida.

8. Un dispositivo de decodificación de imágenes multivista que decodifica datos codificados para imágenes multivista dividiendo una imagen objeto de decodificación de un objeto que es fotografiado por una primera cámara en una pluralidad de zonas objeto de decodificación y, usando una imagen de síntesis de vistas que se sintetiza a partir de la información de profundidad para la imagen objeto de decodificación y a partir de una imagen decodificada del mismo objeto fotografiado por una segunda cámara que está situada en una posición diferente a la de la primera cámara, realizando decodificación predictiva para cada una de las zonas objeto de decodificación, que comprende una unidad de decodificación de imagen (209) que, usando la imagen de síntesis de vistas, decodifica una señal de imagen de la imagen objeto de decodificación; estando el dispositivo de decodificación de imágenes multivista caracterizado porque comprende:

-una unidad de determinación de profundidad representativa (207b) que establece la información de profundidad 45 representativa para un objeto fotografiado en la zona objeto de decodificación,

-una unidad de determinación de grupo de píxeles de muestra (207c) en la que en la imagen objeto de decodificación se determina un grupo de píxeles en el que ha sido fotografiado el mismo objeto que en la zona objeto de decodificación seleccionando píxeles de una zona ya codificada que es adyacente a la zona objeto de codificación, en la que la diferencia absoluta entre un valor de profundidad de la misma y la profundidad representativa es menor que un umbral predefinido y el grupo de píxeles se establece como un grupo de píxeles de muestra,

-una unidad de estimación de parámetros de corrección (207e) que, basándose en la imagen de síntesis de vistas

para el grupo de píxeles de muestra y en una imagen decodificada que ha sido decodificada para el grupo de píxeles de muestra, estima los parámetros de corrección para corregir al menos una de las ausencias de correspondencia de iluminación o de color de manera que se reduzca al mínimo la suma de valores que representan un error entre los valores de píxel de la imagen decodificada para el grupo de píxeles de muestra y los valores de píxel de la imagen de síntesis de vistas para el grupo de píxeles de muestra que son corregidos usando un modelo de corrección para el grupo de píxeles de muestra, y

-una unidad de corrección de imágenes de síntesis de vistas (208) que corrige la imagen de síntesis de vistas para el objeto de manera que se crea una imagen de síntesis de vistas corregida aplicando una función de corrección definida por los parámetros de corrección para la imagen de síntesis de vistas;

en el que la unidad de decodificación de imagen (209) decodifica la señal de imagen de la imagen objeto de

decodificación usando la imagen de síntesis de vistas corregida.

9. Un programa de codificación de imágenes multivista que permite la ejecución del método de codificación de imágenes multivista según una cualquiera de las reivindicaciones 1 a 3 en un ordenador.

10. Un programa de decodificación de imágenes multivista que permite la ejecución del método de decodificación de imágenes multivista según una cualquiera de las reivindicaciones 4 a 6 en un ordenador.

Patentes similares o relacionadas:

Interpolación mejorada de cuadros de compresión de vídeo, del 4 de Diciembre de 2019, de DOLBY LABORATORIES LICENSING CORPORATION: Un método para compresión de imágenes de video usando predicción en modo directo, que incluye: proporcionar una secuencia de cuadros predichos […]

Interpolación mejorada de cuadros de compresión de vídeo, del 4 de Diciembre de 2019, de DOLBY LABORATORIES LICENSING CORPORATION: Un método de compresión de imágenes de video que comprende: proporcionar una secuencia de cuadros referenciables (I, P) y predichos bidireccionales […]

Ponderación adaptativa de imágenes de referencia en codificación de vídeo, del 27 de Marzo de 2019, de InterDigital VC Holdings, Inc: Un aparato de codificación para producir datos de vídeo para una imagen que tiene una pluralidad de bloques de imagen, incluyendo los datos de […]

Un método y un aparato para descodificar/codificar una señal de video, del 17 de Mayo de 2017, de LG ELECTRONICS INC.: Un método para descodificar datos de video multi-visualización en una corriente de video multi-visualización, que comprende: recibir la corriente […]

Procedimiento y dispositivo de decodificación que utiliza codificación subbanda de una unidad de conversión de frecuencia, del 26 de Abril de 2017, de SK TELECOM CO., LTD.: Aparato de decodificación de video que comprende un decodificador para recibir datos codificados para reconstruir un bloque de conversión de frecuencia transformado […]

Método de codificación escalable de vídeo y métodos de decodificación que utilizan predicción ponderada, dispositivos para ello, programas para ello, y medio de grabación donde se graba el programa, del 19 de Abril de 2017, de NIPPON TELEGRAPH AND TELEPHONE CORPORATION: Un método de codificación escalable de video, que comprende: - para cada una de las regiones de imagen de referencia: calcular un coeficiente de […]

Método y dispositivo de control de codificación de predicción intra, su programa, y medio de almacenamiento que contiene programa, del 29 de Marzo de 2017, de NIPPON TELEGRAPH AND TELEPHONE CORPORATION: Un método de control de codificación de predicción intra usado en codificación de predicción intra que tiene una pluralidad de modos de la predicción […]

Método de codificación de imágenes y aparato de codificación de imágenes, del 15 de Febrero de 2017, de Sun Patent Trust: Un método de codificación de imágenes para generar una corriente de bits codificada mediante la codificación de una imagen utilizando una descripción de memoria […]